Postęp technologiczny, który nieustannie obserwujemy wiąże się przede wszystkim z coraz większą popularnością samochodów autonomicznych. Możliwe, że wkrótce staną się one jeszcze bardziej powszechne na całym świecie i użytkowane w codziennym życiu na większą skalę. Tworzenie autonomicznych samochodów ma na celu zmniejszenie ilości wypadków, które często mają charakter śmiertelny. Niestety nie wszystko może działać w sposób autonomiczny. Nasuwają się więc pytania, co zrobi autonomiczny samochód kiedy znajdzie się w sytuacji moralnego dylematu oraz jak zaprojektować odpowiedni algorytm jego działania, kierując się przy tym etyką?

Sztuczna inteligencja – czy jest powodem do obaw?

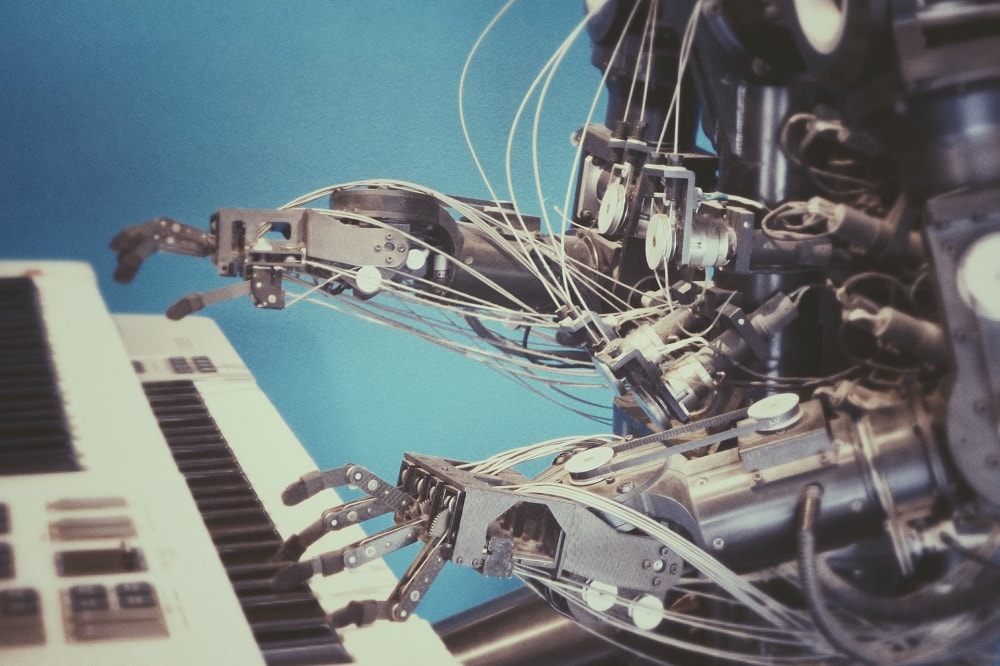

Coraz częstsze wdrażanie i perspektywa jeszcze powszechniejszego używania sztucznej inteligencji (SI) np. w obszarze medycyny, Internetu, transportu, czy robotów wzbudza refleksję nad tym, jakie mogą być potencjalne skutki tych zmian i jaki będzie ich wpływ na funkcjonowanie człowieka. Sztuczna inteligencja definiowana jest na różne sposoby i w rożnym stopniu szczegółowości. Często pytaniem wzbudzającym kontrowersje jest to, czy rozpowszechnienie sztucznej inteligencji przewyższy tę przejawianą przez ludzi. Taki problem można nazwać problemem superinteligencji. Refleksje na ten temat zostały opisywane już przez niektórych autorów. Ogólnie można powiedzieć, że rozwój sztucznej inteligencji budzi w ludziach niepokój. Uważa się np., że w wyniku tego rozwoju nastąpi masowa utrata miejsc pracy, gdy roboty i komputery ostatecznie zastąpią pracowników. Mimo obaw, nie można zaprzeczyć, iż sztuczna inteligencja ma jednak udział w wielu obszarach, przyczyniając się do powstawania wielu udogodnień i komfortowego użytkowania. Znajduje swoje zastosowanie między innymi w obszarze motoryzacji, przyczyniając się do rozwoju technologii w pojazdach.

Moduły moralne w nowych technologiach

Obecnie wzrasta zainteresowanie wdrażaniem modułów etycznych do najnowszych technologii, dzięki którym urządzenia, pojazdy, czy roboty będą podejmować decyzje zgodne z zaprogramowanymi zasadami moralnymi. Pojawiają się np. pomysły by stworzyć roboty, które będą doskonalić ludzką moralność i pilnować czy ludzie nie łamią określonych zasad etycznych. Miałoby to charakter sugestii, popychającej do właściwego postępowania. Naukowcy rozpoczęli prace nad tym, by moralność przełożyć na algorytm komputerowy, tak aby w konkretnej sytuacji robot przeanalizował wszystkie możliwe ścieżki postępowania i wskazał tę najlepszą. Nie wiadomo do końca czy analizowałby je szybciej niż człowiek, a także jakie zasady moralności zaimplementować w technologiach. Czasami nawet ludzie stoją przed poważnymi dylematami moralnymi i trudno im wskazać, co jest właściwym postępowaniem, co sprawia, że przełożenie moralności na program jest niezwykle trudnym zadaniem.

Krótko na temat pojazdów autonomicznych

Na przestrzeni lat możemy obserwować obecność nieustannego rozwoju i coraz bardziej nowoczesnych technologii w wielu dziedzinach życia. Jedną z nich jest z pewnością obszar związany z transportem. Rozwój w tym zakresie ułatwia codzienne życie i komfort podróży. Coraz wyższe oczekiwania względem pojazdów, sprawiają, że przemysł samochodowy jest w ciągłym działaniu, poszukując, jak najlepszych rozwiązań dla użytkowników. Dzięki technologiom informatycznym, autonomicznym czy komunikacji udało się wprowadzić samochody autonomiczne. Mimo, że pomysły samochodu „bez kierowcy” pojawiały się już dawno temu, to nie było możliwości pozwalających na ich wdrożenie. Obecnie widzimy postęp w tym zakresie. Patrząc na zagadnienie samochodów autonomicznych musimy myśleć w sposób interdyscyplinarny, ponieważ na ich tworzenie składa się wiele dziedzin. Zwraca się uwagę na dziedziny związane z transportem, elektroniką, komunikacją i łącznością, technologią informacyjną, oprogramowaniem i sprzętem komputerowym, logistykę, prawo, a nawet etykę i filozofię Ze stopniowym wprowadzaniem ich na rynek wiąże się przede wszystkim wiele korzyści jak np. podwyższenie bezpieczeństwa, niższe koszty transportu i bardziej ekologiczne rozwiązania. Dodatkowo takie pojazdy stworzą także lepsze możliwości dla osób niepełnosprawnych, czy osób starszych. Z racji, iż jest to stosunkowo nowa technologia pojawiają się także różnego rodzaju wątpliwości, związane z funkcjonowaniem takich pojazdów. Dotyczą one wielu kwestii, w tym etycznych.

Kierowca czy pojazd autonomiczny?

Twórcy samochodów autonomicznych przy projektowaniu, dążą przede wszystkim do pozbycia się tego, co powoduje wypadki drogowe. Człowiek prowadzący samochód nierzadko przecież bywa zmęczony, czy znajduje się pod wpływem silnych emocji. Zależy im także na wyeliminowaniu wpływu rozkojarzenia kierowcy na sytuację drogową. Bywają jednak sytuacje, w których to właśnie dzięki zasłudze kierowcy możliwe jest uniknięcie kolizji. W nagłych wypadkach człowiek może odpowiednio zareagować, chociażby wykonując ruch kierownicą w mgnieniu oka. Kiedy na niespodziewaną sytuację natrafi pojazd autonomiczny, reakcja może nie być aż tak natychmiastowa. W tym wypadku decyzja, co do działania będzie spoczywała na programie. Zakłada się, że wynik tych obliczeń będzie optymalny. Mówiąc inaczej, oczekuje się, że program wybierze, jak najmniejsze zło.

Projekt „Moral Machine”

Niektóre sytuacje drogowe wymagają od kierowcy decyzji opartych na moralności. Dla naukowców ważne jest zatem zrozumienie, jak funkcjonuje mechanizm moralności u człowieka. Jest to ważny aspekt, ponieważ dzięki niemu możliwe będzie przełożenie tej wiedzy na maszyny. Pojawia się na przykład kwestia automatyzacji dylematu wagonika, który jest jednym z najsłynniejszych dylematów moralnych. Sytuacje podobne do tego dylematu wyzwalają w nas szybkie reakcje i decyzje. W tym kontekście warto przytoczyć projekt „Moral Machine”, który miał na celu sprawdzenie, jaka jest intuicja moralna ludzi z całego świata, tak żeby wnioski z tych badań można było odnieść do moralności pojazdów autonomicznych. Organizatorzy tego przedsięwzięcia uznali, że nie tylko osoby, powiązane z dziedziną etyki powinny ustalać zasady postępowania takich aut, ale także przeciętni użytkownicy. Każda osoba badana podejmowała decyzję w trzynastu losowych scenariuszach, w których należało wybrać trasę samochodu autonomicznego w sytuacji wypadku, którego nie dało się uniknąć. Na podstawie wyników badacze wyodrębnili trzy główne zasady, które odnosiłyby się do postępowania przez auta autonomiczne, akceptowanego przez społeczeństwo:

- Kiedy jest możliwość, należy oszczędzać ludzkie życie;

- Trzeba dążyć do ocalenia jak największej liczby osób;

- W sytuacjach wypadku, powinno skupiać się ocaleniu najmłodszych.

Badanie VR – Osnabrück University

Innym badaniem, które miało na celu zrozumienie ludzkiej moralności, po ty by potem wykorzystać zasady nią kierujące w pojazdach autonomicznych, było przeprowadzone przez badaczy z Osnabrück University. Przeprowadzili oni eksperyment, w którym badani brali udział w symulacji w wirtualnej rzeczywistości. Uczestnicy jechali dwupasmową podmiejską drogą, w warunkach mgły, mijając liczne przeszkody – ludzii, zwierzęta, obiekty. Zadaniem uczestników było podejmowanie decyzji w różnych scenariuszach, co do tego, kogo lub co potrącić, jak zareagować, czy zdać się na los. To badanie także przyczyniło się do wyodrębnienia kilku modeli zachowań, a dokładnie trzech:

- Pierwszy wiązał decyzję z pojęciem „wartości życia”, który podkreśla korzyści z uniknięcia/zapobieżenia śmierci;

- Drugi model kładł nacisk przede wszystkim na charakter przeszkody, która pojawiła się na jezdni. Duże znaczenie miał np. np. wiek osoby, którą uczestnik badania potrącił. Najczęściej z ludzi ratowano dzieci, a ze zwierząt psy;

- Trzeci model pokazuje, że osoby badane były mniej skłonne do wyboru, jeśli wymagało to szybkiego działania – w takich sytuacjach częściej podejmowali decyzję o nieingerowaniu w kurs jazdy, czemu towarzyszyło rozgrzeszanie samych siebie, mimo, że spowodowali oni większye straty niż w przypadku zmiany pasa.

Analiza wyników pokazała, że pierwszy model najlepiej oddaje dylematy etyczne badanych. Najprawdopodobniej to właśnie taki schemat najłatwiej byłoby przełożyć na algorytm i przełożyć na język autonomicznego samochodu. Oczywiście nie sprawi to, że auto będzie znało zarówno definicje, jak i zasady moralności, ale zachowa się według, tego jak zaprogramują go ludzie, którzy doświadczają podobnych dylematów i sobie z nimi radzą.

Ludzkie uprzedzenia a dylematy moralne w czasie jazdy

Pierwszym krajem, który podjął się tematu zdefiniowania etycznych podstaw dla autonomicznego transportu przyszłości są Niemcy. Pod koniec sierpnia 2017 roku rządowa komisja opublikowała raport ze wskazówkami dla budowy etycznych autonomicznych pojazdów. Jedna z pozycji, które uwzględniono w raporcie, dotyczy podejmowania decyzji moralnych na podstawie charakterystyki człowieka, brzmi ona:

“W sytuacji wypadku, którego nie da się uniknąć, rozróżnianie uczestników na bazie indywidualnych cech (wiek, płeć, status fizyczny i psychiczny) powinno być surowo wzbronione”.

Przewodniczący tej komisji podkreśla, że wyniki niektórych badań w tym zakresie są pełne uprzedzeń i filozofowie oraz prawnicy, w porównaniu do reszty społeczeństwa, zazwyczaj w inny sposób rozumieją etyczne dylematy. Jednocześnie uważa, że nie można poddać się w kontekście ludzkich uprzedzeń, zwłaszcza jeżeli podejmuje się decyzje o życiu i śmierci.

Neuroobrazowanie – a moralność pojazdów autonomicznych

Innym pomysłem na poszukiwanie algorytmu opartego na moralności w przypadku autonomicznych samochodów są badania z wykorzystaniem neuroobrazowania. Za pomocą obserwacji obszarów mózgowych zaangażowanych w rozwiązywanie dylematów etycznych można byłoby lepiej zrozumieć ten mechanizm i przełożyć go do pojazdów bezzałogowych. Przykładem takiego badania, może być to, które przeprowadzono z wykorzystaniem fMRI oraz dwóch scenariuszy wypadków, co do których osoby badane rozstrzygały. W obu wersjach sytuacji drogowej, aktywowały się części kory mózgowej, które związane są z procesami poznawczymi oraz reakcjami emocjonalnymi. Te badania przyczyniły się do powstania wniosku, iż dylematy związane z moralnością generują u człowieka różnego rodzaju emocje. Różnice pomiędzy poszczególnymi osobami badanymi dotyczyły głównie wystąpienia czy też braku reakcji emocjonalnej. Odnosząc tę wiedzę do tworzenia algorytmu dla pojazdów autonomicznych należy zwrócić uwagę na przeszkodę, jaką są emocje. Decyzje ich pozbawione mogą być oczywiście bardziej logiczne i racjonalne, ale warto zastanowić się czy pominięcie aspektu emocji w rozwiązywaniu dylematów mógłby budzić kontrowersje i brak akceptacji wśród społeczeństwa.

Uwzględnienie kosztów i strat

Vanessa Schäffner przedstawiła inne podejście, które można zastosować do opisu tego zagadnienia. Opiera ona swoją koncepcję na zasadach pochodzących z nauk ekonomicznych. Zgodnie z jej założeniami, do rozważania moralności i dylematów związanych z sytuacjami drogowymi możemy przyjąć perspektywę bardziej matematyczną. Takie podejście skupia się przede wszystkim na maksymalizowaniu użyteczności przy pomocy analizy możliwych skutków danego wyboru. Decyzja będzie zależna od tego, ile dana decyzja generuje korzyści i jaki jest ich koszt. Ludzie chętniej skłaniają się do wyborów, które generują najwięcej korzyści najmniejszym kosztem.

Podsumowanie

Kwestie moralności w kontekście pojazdów autonomicznych rozważane są w celu zapewnienia maksymalnego bezpieczeństwa. Oczywiście najlepszym możliwym scenariuszem byłoby zaprogramowanie pojazdów w taki sposób, by w ogóle nie musiały podejmować takich decyzji i mogłyby reagować na sygnały dużo wcześniej.

Literatura

- https://businessinsider.com.pl/technologie/nowe-technologie/autonomiczne-samochody-jak-nauczyc-je-moralnych-wyborow/

- https://filozofiawpraktyce.pl/kogo-potraci-samochod-autonomiczny-moralnosc-pojazdow-bezzalogowych/

- https://www.researchgate.net/publication/323259016_Czy_samochod_autonomiczny_to_samochod_bezpieczny_Is_the_autonomous_car_a_safe_car

- http://studiametodologiczne.amu.edu.pl/wp-content/uploads/2019/04/SM_38-13.pdf?fbclid=IwAR38OKQ78W_7QpafYJQw-KR4e8DuW9I8dzajMwfVxu0rwJqn4AsLZeeKdxw

- https://globegeek.pl/technologie/sztuczna-inteligencja-nie-zastapi-ludzi

- https://mierzynska.marketing/2017/12/25/czy-roboty-naucza-nas-moralnosci/

- https://www.sztucznainteligencja.org.pl/moralne-roboty-to-zly-pomysl/

- https://www.sztucznainteligencja.org.pl/kogo-ma-zabic-autonomiczne-auto-to-zalezy/