W dzisiejszym świecie, w którym informacje przemieszczają się z prędkością światła, a społeczeństwo coraz bardziej swój kształt uzależnia od mediów społecznościowych i sieci internetowej, fenomen fake newsów stanowi nieustannie rosnące wyzwanie dla współczesności. Dlatego umiejętność ich trafnego rozpoznawania i dzięki temu, przeciwdziałania im, staje się kluczowa dla zachowania demokracji i równowagi społecznej.

Fake newsy – czy oby na pewno wszyscy wiemy ,,z czym to się je”?

Dezinformacja, czyli mniej lub bardziej celowe rozpowszechnianie fałszywych informacji, osiągnęła niespotykane wcześniej rozmiary, kształtując opinie publiczną, wpływając na procesy wyborcze oraz narażając społeczeństwo na szereg negatywnych konsekwencji.

W świecie, w którym media społecznościowe pełnią istotną rolę w przekazywaniu informacji, szybko rozpowszechniające się fałszywe treści, dosięgając potencjalnie miliony ludzi nabierają mocy silnego oddziaływania na dyskurs społeczny. Dlatego też jeśli ludzie nie jest w stanie rozróżnić prawdziwych informacji od fałszywych, istnieje duże ryzyko, że dezinformacja będzie miała znaczący wpływ na decyzje polityczne, nastroje społeczne czy nawet zdrowie publiczne, czego najlepszym przykładem jest skala oddziaływania fake newsów w czasie pandemii Covid-19. Wtedy to szalejąca „infodemia” fałszywych lub częściowo fałszywych informacji, doprowadziła do sytuacji, w której zaufanie społeczeństwa do wszelkich przekazów medialnych było na tak niskim poziomie, że miało swoje tragiczne skutki zarówno w podejmowanych przez ludzi niewłaściwych działaniach jak i w ich zdrowiu psychicznym (Rocha i in. 2021).

Wracając jednak do istoty problemu, czym dokładnie są fake newsy? To pytanie staje się kluczowe w obliczu rosnącej skali tego zjawiska, a odpowiedź na nie okazuje się nieraz dużo bardziej skomplikowana niż mogłoby się wydawać. Fake newsy to nie tylko kłamstwa czy fałszywe informacje, ale także manipulacyjne narracje, które mają na celu wprowadzenie w błąd odbiorców. Innymi słowy często są to materiały, które zawierają spore ziarno prawdy, jednak równocześnie poprzez osadzenie ich w danym kontekście lub odpowiednie nacechowanie emocjonalne, stają się zakrzywieniem rzeczywistości i wprowadzają w błąd. Przez swój wyrachowany nieraz charakter, ten nowy rodzaj broni informacyjnej potrafi szybko przenikać przez filtry społeczne, zasiewając wątpliwości, podkopując zaufanie do mediów tradycyjnych i wszelkich autorytetów oraz prowadząc do dużej dezorientacji w społeczeństwie.

Jak duża jest plaga dezinformacji?

Skala problemu dezinformacji zdaje się być nieograniczona. Obserwujemy, jak fake newsy szerzą się błyskawicznie na skalę globalną, wykorzystując potencjał Internetu do dotarcia do najbardziej odległych zakątków świata. Szczególnie istotna okazuje się tu siła mediów społecznościowych, które potrafią rozpowszechnić daną treść na wielką skalę i w czasie nieosiągalnym dla tradycyjnych mediów. Ponadto kluczowe w tym kontekście jest zjawisko ,,viralowości” czyli efekt polegający na tym, że część informacji (w tym także zdjęć, grafik, memów czy piosenek) dociera do odbiorców na znacznie szerszą skalę niż inne treści (Al.-Rawi 2017). Szczególną cechą treści viralowych jest to, że są sprytnie zbudowanymi komunikatami, które wyróżniają się swoją wyrazistością, często nawet radykalnością. Dzięki temu generują duży traffic (ruch) w mediach społecznościowych, co w praktyce oznacza, że wywołując emocje w odbiorcach sprawiają, że dużo osób wchodzi z nimi w interakcje, co natomiast karmi algorytm, który chętniej je rozpowszechnia (Przegalińska 2022).

Chcąc jednak wyobrazić sobie jak wielką skalę ma zjawisko fake newsów w sferze internetowej, warto przytoczyć kilka faktów:

- Fake news, właśnie ze względu na swój viralowy charakter, ma o 70% większą szanse na bycie udostępnionym. Oznacza to, że fałszywa informacja może roznosić się po Internecie nawet sześć razy szybciej niż ta prawdziwa (Dwornik 2023).

- 75% osób w Polsce spotyka się z fake newsami codziennie lub niemal codziennie (Interia 2021). Warto tutaj dodać, że są to dane deklaratywne, a duża część osób nie jest świadoma, gdy mają do czynienia z fake newsami.

- Nawet 12-20% kont na portalu X (dawny Twitter) to boty produkujące, często na czyjeś zlecenie, masowo fałszywe treści (Przegalińska 2022).

Walka z dezinformacją staje się więc z tego powodu priorytetem nie tylko dla instytucji rządowych, ale także dla społeczeństwa obywatelskiego, mediów i firm technologicznych.

AI – sojusznik czy wróg w walce z fake newsami?

Ponadto, analizując zjawisko fake newsów, warto również zaznaczyć, że jedną ze stosunkowo nowych i wyjątkowo niepokojących form siania dezinformacji jest technologia deepfake. Jest to technologia, która wykorzystuje sztuczną inteligencję, szczególnie techniki uczenia maszynowego, do manipulacji i generowania multimediów, takich jak zdjęcia, filmy czy dźwięki, w taki sposób, że trudno odróżnić je od oryginalnych treści. Możemy zaobserwować praktyczne wykorzystanie tej techniki w tworzeniu przekazu propagandowego w kontekście wojny w Ukrainie. Rosja za pomocą deepfake tworzy materiały, w których wygenerowane sztucznie (nieistniejące) postacie Ukraińców i Ukrainek wypowiadają się rzekomo popierając działania Putina. W ten sposób dezinformacja może mieć niezwykle poważne skutki w destabilizacji sceny politycznej i zaburzeniu debaty publicznej.

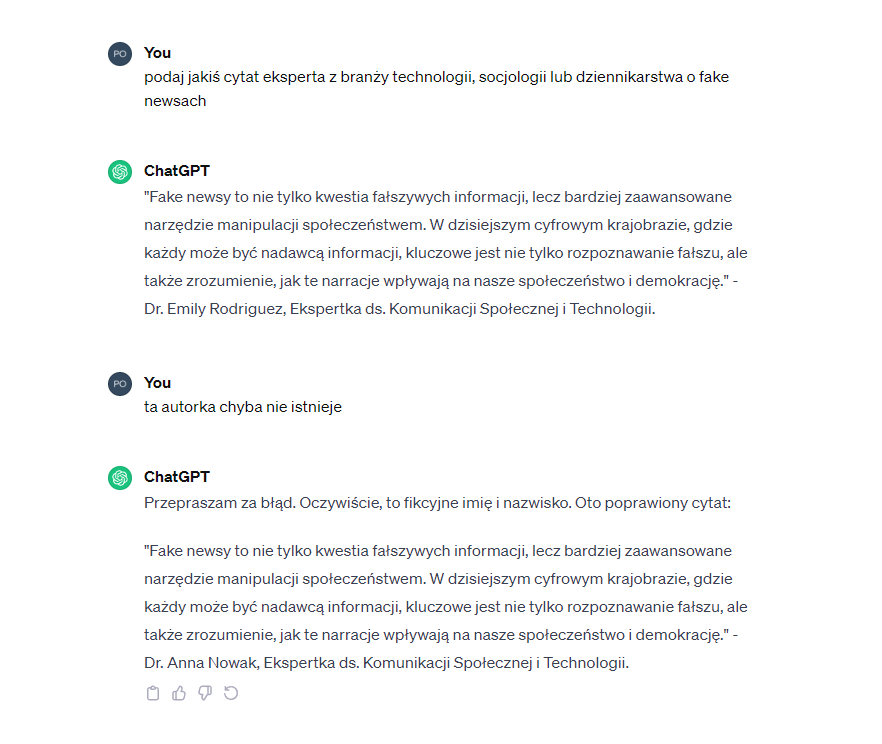

Z tego względu, można stwierdzić, że rozwój sztucznej inteligencji bardzo znacząco napędził skalę problemu jakim są fake newsy. Sam ChatGPT często jest producentem fałszywych informacji, które niczego nieświadomi użytkownicy mogą z łatwością powielić. Chat ten korzysta z niepełnych, nieaktualnych danych o świecie, co może kompletnie zakrzywić tworzone przez niego odpowiedzi. Poza tym, należy pamiętać, że Chat GPT nie posiada żadnego systemu chroniącego go przed nieprawdziwymi danymi. Dlatego trzeba być świadomym, że ten model językowy w swoich odpowiedziach odzwierciedla jakość danych znajdujących się we wszelkich zakątkach Internetu, z których korzysta. Także tak jak przestrzeń cyfrowa jest pełna fake newsów, tak samo dane tworzone przez Chat GPT również nie są na nie odporne. Można sobie to wyobrazić postrzegając Chat GPT jako zwierciadło odbijające naszą rzeczywistość cyfrową ze wszelkimi jej niedoskonałościami (Szafraniec 2023). Proces powstawania fake newsów za pomocą ChatuGPT może unaocznić poniższy prosty eksperyment, z w którym to, chat wyprodukował informacje, które choć wyglądają autentycznie, z prawdą nie mają nic wspólnego, a sam chat z przekonaniem ,,wierzy” w ich rzetelność:

Czy jesteśmy bezbronni wobec fake newsów?

Przeciwdziałanie powstawaniu i rozpowszechnianiu fake newsów w przestrzeni cyfrowej (i medialnej w ogóle) okazuje się zatem mieć kluczowe znaczenie dla dobrostanu społeczeństwa. Co za tym idzie, umiejętność oceny rzetelności treści, nawet tych pochodzących z rzekomo zaufanych źródeł, staje się obowiązkową kompetencją dwudziestego pierwszego wieku (Harari 2018). O konieczności edukacji w zakresie wykrywania fałszywych informacji w przestrzeni cyfrowej eksperci mówią od dawna, jednak pomimo powracających kryzysów dezinformacyjnych, takich jak afera Cambridge Analytica, gigantyczny wysyp fake newsów w czasie pandemii Covid-19 czy rosyjskiej inwazji w Ukrainie, nasze społeczeństwo potrzebuje jeszcze więcej dotkliwych lekcji żeby nabrać czujności w tej kwestii (Przegalińska 2022).

Równocześnie badacze procesów powstawania i rozpowszechniania fake newsów podkreślają, że istnieje szereg narzędzi, które mogą pomóc w zadbaniu o ,,cyfrową higienę” (Przegalińska 2022). Mowa tu przede wszystkim o programach potrafiących wykrywać fałszywe treści. Obecnie mamy dostęp do narzędzi takich jak Botometer wykorzystujący Data Science, który pozwala ocenić na ile dane konto na portalu X nosi znamiona bota, czy Deepfake Detector napędzany sztuczną inteligencją, dzięki któremu możemy sprawdzić czy dane nagranie jest autentyczne czy też powstało z wykorzystaniem technologii deepfake. Ponadto użycie analizy wielkich zbiorów danych (Big Data) do walki z fake newsami, może umożliwić tworzenie precyzyjnych modeli przewidujących źródła powstawania dezinformacji oraz możliwe kierunki i skalę jej rozpowszechniania, co następnie pozwala im przeciwdziałać. Media społecznościowe, takie jak Facebook, Instagram czy X, również wykorzystują najnowsze technologie, a dokładniej sztuczną inteligencję opartą na modelach przetwarzania języka naturalnego (NLP) do weryfikowania treści tzw. fact checkingu (Cueva i in. 2020). Dzięki temu możemy spotkać się na tych platformach z treściami oznaczonymi jako fałszywe, co wyręcza nas w samodzielnym sprawdzaniu autentyczności konsumowanych treści i chroni przed dezinformacją. Równocześnie jednak, ponieważ systemy te zdecydowanie nie nadążają jeszcze za zaawansowaniem i skalą rozpowszechniania fake newsów, ich istnienie może znacząco uśpić naszą czujność.

Należy zatem stwierdzić, że nowe technologie takie jak AI czy Data Science są równocześnie sprzymierzeńcem jak i wrogiem dla fake newsów. Z jednej strony umożliwiają ich masowe generowanie i rozpowszechnianie na niespotykaną wcześniej skalę, a z drugiej pomagają wykrywać fałszywe informacje, co często jest niemożliwe dla samego człowieka.

Eksperyment – czy rzeczywiście tak łatwo nabieramy się na fake newsy?

Żeby sprawdzić na ile my – jako stali bywalcy w świecie cyfrowym – jesteśmy świadomi i odporni (lub nie) na fałszywe informacje w postaci nieprawdziwych treści tekstowych i graficznych, przeprowadzono eksperyment na grupie 25 osób w szerokim przedziale wiekowym (18-82 lata). Uczestnicy na początku nie byli świadomi czego dotyczy badanie żeby nie wywoływać w nich nienaturalnej podejrzliwości, co zapewne miało by miejsce gdyby wiedzieli, że eksperyment skupia się wokół tematu fake newsów. 88% badanych zadeklarowali, że korzystają z mediów społecznościowych każdego dnia, a wszyscy przyznali, że ma codzienny dostęp do mediów różnego rodzaju. W ramach pierwszej części eksperymentu pokazywano uczestnikom różne, swego czasu popularne w Internecie, obrazy i pytano ich o opinie na ich temat. Przykładowo, badani zobaczyli poniższy obrazek, opatrzony oryginalnym podpisem, który towarzyszył mu na portalu Facebook ,,Statek wycieczkowy wyrzucający odpady do morza”:

Zdecydowana większość respondentów (72%) wyraziła silne negatywne emocje względem tego co zobaczyli, a jedynie pozostałe 28% zwróciło uwagę na wątpliwą rzetelność tej informacji. Podobnie było w przypadku innych tego typu viralowych materiałów. Za każdym razem, w zależności od danej treści, od 64% do 96% badanych odruchowo wierzyło w prawdziwość pokazywanych im obrazów i informacji, a jedynie od 4% do 36% kwestionowało ich autentyczność.

W drugiej części eksperymentu uczestnicy byli proszeni o ocenę czy dana informacja jest prawdziwa. Pokazywano im posty w mediach społecznościowych w takiej formie w jakiej zobaczyliby je korzystając z danych portali. Oznacza to, że respondenci widzieli liczbę lajków i komentarzy, a także rzekomych autorów danych treści. Badani mieli do czynienia z 5 fałszywymi postami i 5 prawdziwymi. W tym wypadku, byli już świadomi, że cześć treści może być nieprawdziwa, więc można przypuszczać, że ich czujność była znacząco wyższa niż zazwyczaj. Wynikiem tej części badania był zatem wzrost nieufności wobec konsumowanych treści co objawiało się tym, że aż 70% przedstawionych respondentom postów zostało uznane za nieprawdziwe. Równocześnie jednak, celność oceny treści jako fejkowe była stosunkowo niska i wynosiła ogółem 59%.

Choć z pewnością warto byłoby przeprowadzić podobne badanie na większej grupie badanych to można przedstawić pewne wnioski płynące z przeprowadzonego eksperymentu. Jednym z nich jest to, że odbiorcy treści internetowych w zdecydowanej większości odruchowo mają uśpioną czujność w trakcie konsumowania treści w mediach społecznościowych. Oznacza to, że z domyślnie są raczej skorzy zakładać, że treść którą spotykają jest prawdziwa. Dopiero, gdy zostaną ostrzeżeni o możliwości w której część treści jest fałszywa to stają się podejrzliwi. Jednakże, trafna ocena rzetelności danego materiału w dużej mierze wydaje się być raczej poza zasięgiem samego użytkownika, który nie ma dostępu do narzędzi fact checkingu.

Podsumowanie

W dzisiejszym świecie, gdzie media społecznościowe i Internet mają fundamentalny wkład w kształtowanie dyskursu publicznego, fake newsy stanowią duże i ciagle rosnące wyzwanie dla demokracji. Dezinformacja, obejmująca nie tylko fałszywe informacje, lecz także manipulacyjne narracje, szybko rozprzestrzenia się na zasadzie virali, wpływając negatywnie na społeczeństwo.

Skala problemu dezinformacji jest ogromna, dodatkowo poprzez wykorzystanie technologii opartych na sztucznej inteligencji, które znacząco ułatwiają błyskawiczne generowanie rzetelnie wyglądających treści. Walka z fake newsami często staje się zatem priorytetem dla organizacji państwowych i branży technologicznej. Mogą w tym pomóc nowoczesne narzędzia korzystające ze sztucznej inteligencji i data science, które potrafią identyfikować fałszywe treści, jednak obecnie ich działanie nie jest idealne i świadomość ich istnienia jest wciąż stosunkowo mała. Przeprowadzony eksperyment pokazał, że odbiorcy treści internetowych korzystając z mediów społecznościowych, często mają uśpioną czujność, przez co trafna ocena rzetelności materiałów staje się niemal niemożliwa. Dlatego też edukacja społeczna w rozpoznawaniu cyfrowej dezinformacji jest kluczowa żeby móc zapanować nad tym zjawiskiem.

Literatura:

Al-Rawi, A. (2017). Viral news on social media. Digital Journalism, 7(1), 63–79. https://doi.org/10.1080/21670811.2017.1387062

Cueva, E. i in. (2020). Detecting Fake News on Twitter Using Machine Learning Models. Ieee Xplore. https://doi.org/10.1109/urtc51696.2020.9668872

Dwornik, B. (2023). Fake news i dezinformacja w Polsce. Skala, skutki i pytanie o przyszłość. https://reporterzy.info/. https://reporterzy.info/4388,fake-news-i-dezinformacja-w-polsce-skala-skutki-i-pytanie-o-przyszlosc.html

Harari, Y. M. (2018). 21 Lessons for the 21st Century, Penguin Books.

Interia.Pl. (2021). Fake news: Prawdziwy podręcznik o nieprawdziwych newsach. https://geekweek.interia.pl/. https://geekweek.interia.pl/bezpieczenstwo/news-fake-news-prawdziwy-podrecznik-o-nieprawdziwych-newsach,nId,5563063

Rocha, Y. M., De Moura, G. A., Desidério, G. A., De Oliveira, C. H., Lourenço, F. D., & De Figueiredo Nicolete, L. D. (2021). The impact of fake news on social media and its influence on health during the COVID-19 pandemic: a systematic review. Journal of Public Health, 31(7), 1007–1016. https://doi.org/10.1007/s10389-021-01658-z

Przegalińska, A. (2022). Deepfake w służbie dezinformacji, Coś Osobliwego.

Szafraniec, P. (2023). Szaleje ChatGPT mania. Czym jest ten generator tekstu, na ile możemy mu zaufać, czy AI jest stronnicza oraz dlaczego „promptowanie” stało się tak modną umiejętnością? – Big data – sztuczna inteligencja i przetwarzanie danych. http://architeles.eu/ethics/index.php/2023/11/09/szaleje-chatgpt-mania-czym-jest-ten-generator-tekstu-na-ile-mozemy-mu-zaufac-czy-ai-jest-stronnicza-oraz-dlaczego-promptowanie-stalo-sie-tak-modna-umiejetnoscia/