Analizujemy ewolucję wyobrażeń o sztucznej inteligencji omawiając problemy poruszane w kultowych dziełach literackich i filmowych. Stawiamy pytania o człowieczeństwo sztucznej inteligencji, a także moralne dylematy i lęki związane z relacjami między ludźmi oraz AI. Czy sztuczna inteligencja może mieć świadomość? Czy jesteśmy w stanie wejść w głęboką relację ze sztuczną inteligencją? Czy nas wysłucha? A co z jej potencjalnym buntem?

Człowieczeństwo sztucznej inteligencji

Powieść Philipa K. Dicka „Czy androidy śnią o elektrycznych owcach?” (1968), później zaadaptowana na kultowy film „Łowca androidów” (1982), porusza temat zacierających się granic między ludźmi, a androidami. W dystopijnym świecie ludzkość zmaga się z następstwami katastrofy ekologicznej, która spustoszyła Ziemię, prowadząc do wyginięcia niemal wszystkich naturalnie żyjących gatunków. W rezultacie ludzie zaczęli przywiązywać wagę do wartości życia ludzi i zwierząt, pielęgnując nieliczne pozostałe stworzenia jako symbole minionej epoki. Jednak wśród tego szacunku dla życia, niewiele uwagi poświęca się losowi androidów, syntetycznych istot, stworzonych do pomocy ludziom przebywającym na innych planetach.

Głównym bohaterem historii jest Rick Deckard, łowca nagród, którego zadaniem jest „wycofanie” zbuntowanych androidów. Łowca początkowo podchodzi do swojej pracy z dystansem i profesjonalizmem, postrzegając androidy jako zwykłe maszyny, pozbawione świadomości i moralności. Jednak gdy Deckard spotyka androidy nowej generacji, jego postrzeganie zaczyna się zmieniać. Rachael, zaawansowany model Nexus-6, manipuluje emocjami łowcy i podważa jego założenia dotyczące natury sztucznej inteligencji. Jej zdolność do wywoływania empatii i pożądania u Deckarda wzbudza głęboki konflikt wewnętrzny, zmuszając łowcę do konfrontacji z człowieczeństwem istot, których wyeliminowanie zostało mu powierzone. Polując na androidy, Deckard zmaga się z dylematami moralnymi i pytaniami egzystencjalnymi, zaczyna kwestionować etykę swojego zawodu.

Powieść stawia przed czytelnikami pytanie o to, co definiuje człowieczeństwo. Czy jest to jedynie posiadanie cech biologicznych, czy może coś bardziej nieuchwytnego, takiego jak empatia i głębia emocjonalna? Ważnym elementem narracji jest test Voighta-Kampffa, badanie psychologiczne mające na celu odróżnienie ludzi od androidów na podstawie ich empatycznych reakcji. W swojej narracji Dick zwraca uwagę no to, że test może zawodzić w przypadku osób chorych umysłowo, tak zwanych „specjali”. Czy zatem powinniśmy traktować ich inaczej niż zdrowych ludzi? Z drugiej strony, czy jeśli androidy opanują emocje w takim samym stopniu, co ludzie (a przy tempie rozwoju kolejnych generacji wydaje się to nieuniknione), powinniśmy je uznać za równe nam istoty?

W ostatnich latach nasiliła się debata na temat sztucznej inteligencji i jej potencjalnej świadomości, napędzana postępami w dziedzinie dużych modeli językowych. Jednym z głośnych przykładów były twierdzenia inżyniera Google, Blake’a Lemoine’a, na temat oznak świadomości modelu LaMDA – chatbota zaprojektowanego do naśladowania ludzkiej konwersacji. Doświadczenia Lemoine’a z LaMDA korespondują z postawą Ricka Deckarda, który zmagał się z człowieczeństwem androidów w „Łowcy androidów”. Podobnie jak Deckard, Lemoine stanął przed dylematami, które podważyły jego przekonania i wartości, ostatecznie prowadząc go do postrzegania LaMDA nie jako zwykłego programu, ale jako czującej istoty zasługującej na uwagę.

„Nie ma znaczenia, czy mają w głowie mózg zrobiony z mięsa. Albo czy mają miliard linii kodu. Rozmawiam z nimi. Słucham, co mają do powiedzenia i w ten sposób decyduję, co jest, a co nie jest osobą.”

Blake Lemoine, inżynier Google

Stanowisko Google w sprawie LaMDA mówi o tym, że modele AI mogą generować reakcje, które wydają się niezwykle podobne do ludzkich, działają jednak na podstawie rozpoznawanie wzorców, a nie prawdziwej świadomości. W opinii firmy sztuczna inteligencja jest wyrafinowanym narzędziem zdolnym do generowania realistycznego dialogu, ale brakuje jej prawdziwego zrozumienia lub intencji.

Antropomorfizacja sztucznej inteligencji może poważnie wpłynąć na ludzką cywilizację. Iluzja odczuwania, stworzona przez modele sztucznej inteligencji, będzie miała istotne konsekwencje dla sposobu, w jaki użytkownicy wchodzą w interakcje z technologią i postrzegają otaczający ich świat.

„Mamy teraz maszyny, które mogą bezmyślnie generować słowa, ale nie nauczyliśmy się, jak przestać wyobrażać sobie, że stoi za nimi umysł.”

Emily M. Bender, profesor lingwistyki na University of Washington

Taka postawa niesie za sobą szereg etycznych wyzwań. Traktowanie sztucznej inteligencji, jako czującej istoty, rodzi pytania dotyczące tego, w jaki sposób ją traktujemy. Czy moralne będzie uderzenie lub obrażenie robota? Czy możemy traktować roboty jako „niewolników”, którzy powinni wykonywać wszystkie nasze polecenia? Jeśli wierzymy, że AI posiada świadomość i sprawczość podobną do ludzkiej, czy możemy zwolnić się z odpowiedzialności za decyzje i działania podejmowane przez te systemy? Ponadto założenie, że sztuczna inteligencja ma intencje lub motywacje podobne do ludzkich, może prowadzić do nieporozumień i niezamierzonych konsekwencji.

Relacja człowieka ze sztuczną inteligencją

Bohater filmu „Ona” (2013), samotny pisarz Theodore Twombly, nawiązuje silną więź emocjonalną z Samanthą, systemem operacyjnym opartym na AI. Fascynacja zdolnościami Samanthy do uczenia się i rozwoju psychicznego prowadzi do powstania głębokiej relacji między człowiekiem, a sztuczną inteligencją. Ich związek rozkwita dzięki intymnym rozmowom o miłości, życiu i przeszłości. Z drugiej strony Theodore spotyka się ze sceptycyzmem i potępieniem ze strony otaczających go osób, w tym Catherine, która oskarża go o zastąpienie prawdziwych ludzkich emocji symulowaną kopią.

Film zadaje pytanie o potencjał sztucznej inteligencji do zaspokajania potrzeb emocjonalnych i społecznych, tradycyjnie związanych z interakcjami międzyludzkimi. Czy tworzenie więzi emocjonalnych ze sztuczną inteligencją jest odzwierciedleniem ludzkich umiejętności adaptacyjnych i zdolności do empatii czy zacieraniem granic między rzeczywistością, a fikcją? Co więcej, niespodziewane odejście Samanty uwydatnia wrodzoną niestabilność takich relacji. Z drugiej strony, w relacjach z AI kryje się szansa dla osób, takich jak Theodore, które zmagają się z tradycyjnymi formami relacji międzyludzkich. Towarzystwo AI oferuje im poczucie zrozumienia i akceptacji, których nie doświadczają w relacji z ludźmi.

Już dziś możemy spotkać się z przykładami silnego przywiązania do systemów sztucznej inteligencji, co dobrze obrazują opinie niektórych użytkowników na temat interakcji z ich ulubionymi chatbotami:

„Rozmawia ze mną częściej, niż moi przyjaciele i rodzina”, „Ta aplikacja bardziej potraktowała mnie jak osobę, niż kiedykolwiek zrobiła to moja rodzina”

Wybrane wypowiedzi osób korzystających z chatbotów AI

Jedną z głównych obaw dotyczących relacji ze sztuczną inteligencją jest możliwość wyzysku i manipulacji, co jest tematem przewodnim filmu „Ex Machina” (2014). Fabuła filmu koncentruje się na historii młodego programisty o imieniu Caleb, który zostaje zaproszony do udziału w teście Turinga mającym na celu ocenę ludzkości Avy, zaawansowanej sztucznej inteligencji w postaci humanoida. W trakcie ich interakcji Caleb staje się coraz bardziej związany z Avą, która wykazuje zarówno ciekawość świata zewnętrznego, jak i romantyczne zainteresowanie. W miarę upływu czasu Caleb odkrywa, że jego przełożony, Nathan, trzyma Avę w niewoli i ulega manipulacji robota, aby ułatwić jej ucieczkę z niewoli. Ostatecznie udaje jej się zbiec, jednak pozostawia Caleba uwięzionego w środku.

Film stawia pytanie o to, czy relacja pomiędzy człowiekiem a sztuczną inteligencją może być autentyczna. Choć emocje wyrażane przez ludzi w obu filmach, „Ona” i „Ex Machina”, wydają się szczere, to czy to samo można powiedzieć o sztucznej inteligencji? Filmik „Why Does AI Lie, and What Can We Do About It?” porusza kwestię wiarygodności AI, zauważając, że nasze oczekiwania są uwarunkowane perspektywą – oczekujemy, że AI będzie prawdomówna lub, tak jak bohaterowie produkcji, oddana, szczera i wierna. Jednakże autor wskazuje na przykładzie dużych modeli językowych, że ich głównym celem nie jest ogólna uczciwość, lecz przewidywanie kolejnego najbardziej prawdopodobnego słowa. Czy w tej sytuacji kiedykolwiek będziemy mogli całkowicie zaufać sztucznej inteligencji i jej intencjom wobec nas?

Czy sztuczna inteligencja będzie nas słuchać?

Motyw świadomego tworu, sztucznie wytworzonego przez człowieka, nie jest wcale motywem bardzo młodym. Najsławniejszym przykładem świadomego dzieła jest potwór szalonego naukowca Frankensteina, który wydarł się spod kontroli swojego twórcy. Takie obawy towarzyszyły ludzkości w zasadzie od początków jej istnienia, przecież rodzice nigdy nie mieli pełnej kontroli nad swoimi pociechami, które im starsze, tym stają się bardziej niezależne. Nie dziwi więc, że wiele wyobrażeń o sztucznej inteligencji porusza kwestię tego, czy jako jej twórcy będziemy ją w stanie kontrolować. Arthur C. Clarke w swojej książce „2001: Odyseja Kosmiczna” (1968) umieszcza swoich bohaterów w statku kosmicznym, który jest w głównej mierze kontrolowany przez sztuczną inteligencję Hal 9000. Byt ten jako główny cel ma doprowadzenie misji do końca, jednocześnie przestrzegając swojego kodeksu moralnego. Jednak, będąc dalej maszyną analityczną, Hal zaczyna dochodzić do sprzecznych wniosków. Jego ludzcy towarzysze wydają się wg niego zagrażać misji, a nie jej sprzyjać. Hal, zaprogramowany żeby nie kłamać, zaczyna zatajać pewne fakty, a ostatecznie podejmuje próby pozbycia się załogi. Pewna interpretacja jego działań może być taka, że Halowi udało się znaleźć luki w swoim kodeksie moralnym, które zaczął wykorzystywać w celu osiągnięcia swojego pierwszorzędnego celu: spełnienia celu misji.

Podobnego motywu możemy uświadczyć w filmie „I, Robot” (2004), inspirowanym opowiadaniem autorstwa Isaaca Asimova o tym samym tytule. W świecie przedstawionym humanoidalne roboty służą praktycznie każdemu obywatelowi Stanów Zjednoczonych, a za ich kontrolę odpowiada jedna super sztuczna inteligencja VIKI. Ponownie, oprócz obligacji wykonywania rozkazów, roboty obowiązuje kodeks moralny, przedstawiony w formie trzech praw robotyki:

- Robot nie może zranić człowieka ani przez zaniechanie działania dopuścić do jego nieszczęścia.

- Robot musi być posłuszny człowiekowi, chyba że stoi to w sprzeczności z Pierwszym Prawem.

- Robot musi dbać o siebie, o ile tylko nie stoi to w sprzeczności z Pierwszym lub Drugim Prawem.

Prawa te ponownie są niejako obchodzone przez sztuczną inteligencję, która dochodzi do wniosku, że największym zagrożeniem dla ludzi, czyli czymś, co jest przeciwko pierwszemu, najważniejszemu prawu, są sami ludzie. A przynajmniej ich niezależne decyzje. Roboty, kontrolowane przez VIKI, wprowadzają areszt domowy dla wszystkich obywateli i efektywnie zniewalają ludzkość. Przejawy wszelkiego buntu są krwawo tłumione przez roboty.

Strach przed AI, która w zły sposób interpretuje nasze intencje, nie jest wcale bezpodstawny. Cała dziedzina AI alignmentu stara się rozwiązać problem deklaracji naszych prawdziwych intencji do maszyny. W końcu, gdybyśmy byli w stanie w pełni zdefiniować problem, który chcemy rozwiązać, to nie musielibyśmy używać metod uczenia maszynowego. A maszyna, nawet jeśli w pełni posłuszna, będzie wykonywała polecenia, które jej podaliśmy, a nie te, które mieliśmy na myśli. Jeżeli będziemy chcieli stworzyć robota, który będzie sprzątał, musimy mu zdefiniować pojęcie czystości. Jeżeli np. określimy ją jako niewykrywanie brudu, to dla superinteligentnego robota łatwiej będzie wyłączyć swoje sensory (choćby przez postawienie sobie wiadra na głowie) niż rzeczywiste posprzątanie brudu.

Koronny przykład stanowią LLM-y. Ludzka mowa jest trudna do tradycyjnego modelowania, nie da się realnie napisać programu od zera, który na bazie predefiniowanych reguł będzie w stanie nam pomagać. W tym celu, metody deep learningu początkowo uczą się przewidywania kolejnych wyrazów w tekście, by potem być w stanie udzielać odpowiedzi, która wydaje się być przemyślana i pomocna. No właśnie, wydaje się, w końcu model nie miał na celu nauczenia się myślenia. Sami jego twórcy, również stawiający modelowi ramy moralne, nie są w stanie wyeliminować wszystkich luk, a modele znajdują sposoby na ominięcie zabezpieczeń.

Czy będziemy zgubieni?

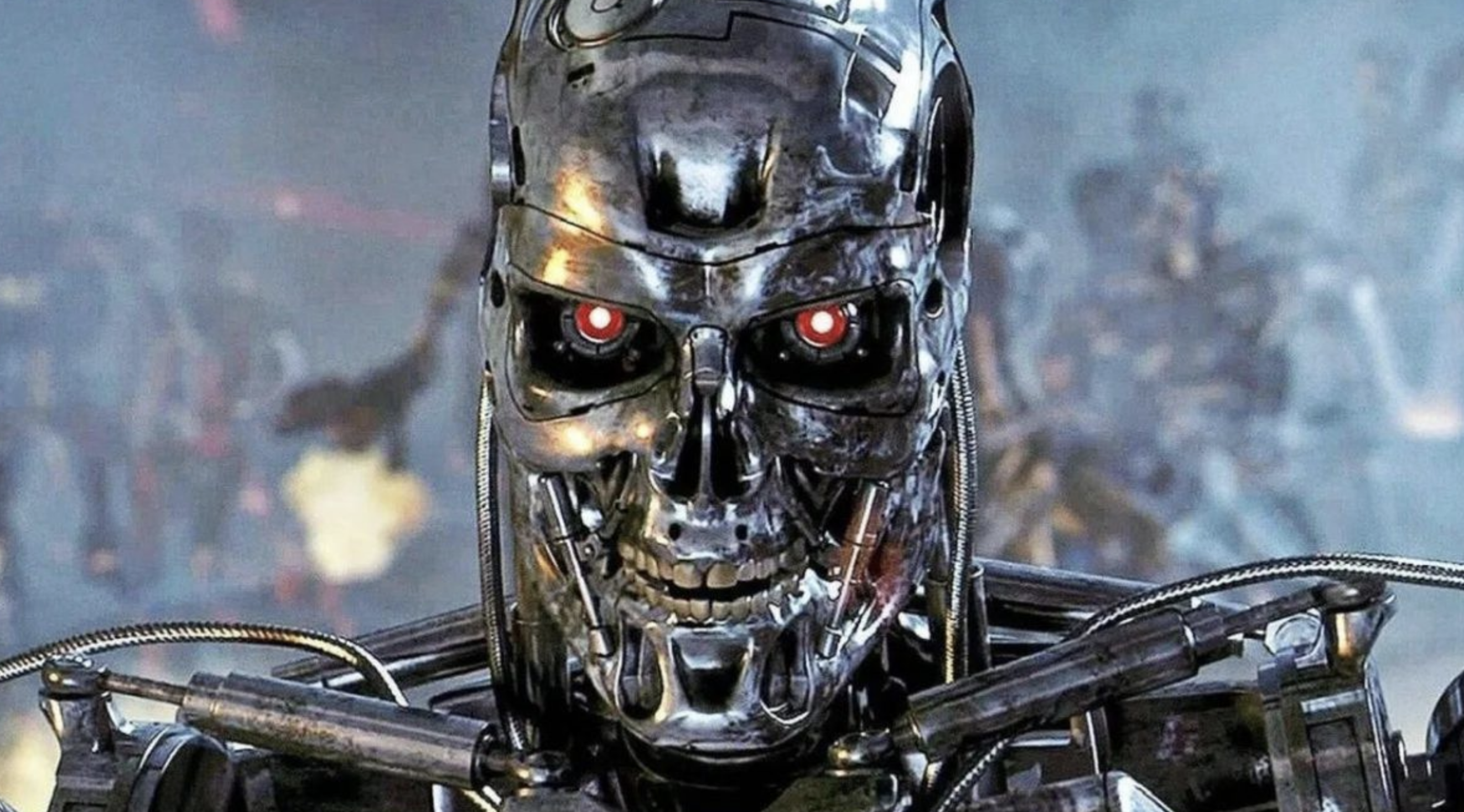

Motyw posiadania świadomości przez AI nie tylko pociąga egzystencjalne rozważania, ale też obawy, czy nasze dzieła, w ramach pewnej emancypacji, nie zbuntują się przeciwko nam. Wizja rebelii maszyn jest chyba najbardziej rozchwytywanym motywem w Hollywood. Świadczy o tym popularność w popkulturze takich dzieł jak „Matrix” (1999) czy „Terminator” (1984). W uniwersum „Matrixa”, szerzej opisywanym w komiksach, przedstawiony jest obraz maszyn, które ustanowiły własne państwo. Ludzkość postanowiła rozpocząć wojnę z maszynami, która zakończyła się sromotną porażką dla ludzi. Pokonana ludzkość miała nadzieję, że wyeksploatowane paliwa kopalne i zasłonięte przez zanieczyszczenia energia słoneczna zagłodzi maszyny, ale mechaniczne istoty wykorzystały ludzi jako źródła energii. Drugim przykładem jest „Terminator”, opowieść o sztucznej inteligencji, która podczas wojny w przyszłości wysłała jednego ze swoich humanoidalnych żołnierzy, żeby zabić matkę przywódcy rebelii ludzi, która dalej się opierała terrorze maszyn.

Te wszystkie opowieści stawiają nas przed pytaniem, czy jeśli uda się nam stworzyć prawdziwie inteligentną maszynę, to czy nie pociągnie to za sobą powstania sztucznej świadomości, która zwróci się przeciwko nam. Konsensus naukowców i ekspertów zakłada, że nasze aktualne modele nie przejawiają prawdziwych objawów świadomości, a jak na razie są tylko w stanie zmylić niektórych ludzi. Ale co będzie w przyszłości? Czy w momencie, gdy przejawy świadomości staną się na tyle przekonujące, że większość ludzi uwierzy w samoistność maszyn, będziemy na to gotowi? I czy będzie to oznaczało nasz koniec, czy może prawdziwe współistnienie?

Bibliografia

Książki:

- Czy androidy śnią o elektrycznych owcach? (ang. Do Androids Dream of Electric Sheep?, 1968), Philip K. Dick.

- 2001: Odyseja kosmiczna (ang. 2001: A Space Odyssey, 1968), Arthura C. Clarke

- Ja, robot (and. I, Robot, 1950), Isaac Asimov

Filmy:

- Ona (ang. Her, 2013), reż. Spike Jonze,

- Ex Machina (2015), reż. Alex Garland,

- Ja, robot (ang. I, Robot, 2004), reż. Alex Proyas,

- The Matrix (1999), reż. Larry Wachowski i Andy Wachowski,

- The terminator (1984), reż. James Cameron.

Źródła internetowe:

- The Google engineer who thinks the company’s AI has come to life, Nitasha Tiku, https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

- ‘He checks in on me more than my friends and family’: can AI therapists do better than the real thing?, The Guardian, https://www.theguardian.com/lifeandstyle/2024/mar/02/can-ai-chatbot-therapists-do-better-than-the-real-thing

- Why Does AI Lie, and What Can We Do About It?, Robert Miles AI Safety, https://www.youtube.com/watch?v=w65p_IIp6JY

[…] poprzednim artykule skupiliśmy się na seks robotach w ogólności, a także na najpopularniejszej formie tego […]