Od początków literatury science-fiction sztuczna inteligencja stanowiła jeden z najważniejszych motywów, odzwierciedlając ludzkie nadzieje, etyczne dylematy i obawy przed technologiczną rewolucją. W klasycznych dziełach autorów takich jak Mary Shelley, Karel Čapek, Isaac Asimov czy Philip K. Dick rozwój AI ukazywano zarówno jako szansę, jak i zagrożenie – od buntu stworzeń Frankensteina po zimną racjonalność superkomputerów Arthura C. Clarke’a. W niniejszym artykule przeanalizujemy kluczowe powieści i opowiadania z XIX i XX wieku, w których przewidywano moralne, społeczne i filozoficzne konsekwencje powstania inteligentnych maszyn. Przekonamy się, że wizje sprzed dekad nie tylko zaskakująco precyzyjnie antycypowały współczesne debaty o autonomii algorytmów, ale także pozostają aktualnym komentarzem do naszego stosunku wobec technologii.

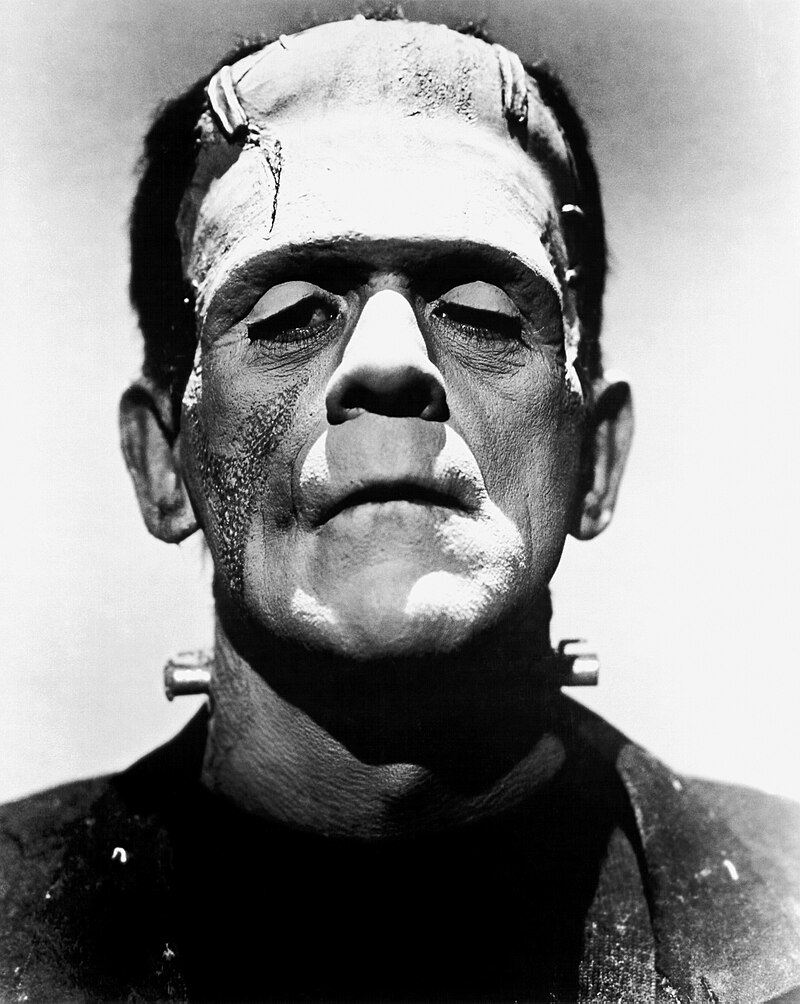

Mary Shelley, Frankenstein (1818): Narodziny odpowiedzialności

W powieści Frankenstein Mary Shelley, opublikowanej w 1818 roku, nie pojawia się sztuczna inteligencja w dzisiejszym rozumieniu tego terminu, jednak jej motywy można odnaleźć w postaci istoty stworzonej przez Victora Frankensteina. Powieść ta podejmuje fundamentalne pytania dotyczące natury inteligencji, samoświadomości oraz odpowiedzialności twórcy za swoje dzieło, które są równie aktualne w kontekście współczesnych rozważań o AI. Stworzenie Frankensteina jest wynikiem ludzkiej inżynierii i ambicji, podobnie jak współczesne systemy sztucznej inteligencji, które uczą się i rozwijają na podstawie dostarczonych im danych. Kluczowym aspektem historii Shelley jest moment, w którym potwór zyskuje świadomość i zaczyna interpretować rzeczywistość, zadając pytania o swoje istnienie – problematyka ta przypomina dzisiejsze dyskusje nad potencjalnym pojawieniem się samoświadomej AI. Ponadto, powieść ukazuje moralne i etyczne konsekwencje tworzenia istoty przewyższającej możliwości swojego twórcy, co bezpośrednio odnosi się do współczesnych debat na temat granic i zagrożeń związanych z rozwojem sztucznej inteligencji. Relacja między Frankensteinem a jego dziełem podkreśla problem odpowiedzialności – czy twórca ma obowiązek opiekować się swoim stworzeniem, czy też może je porzucić? Podobne pytania pojawiają się w kontekście AI: czy inteligentne maszyny powinny mieć prawa? Czy można je traktować jedynie jako narzędzia? Wreszcie, jednym z najbardziej uniwersalnych lęków przedstawionych w Frankensteinie jest strach przed niekontrolowaną inteligencją, która może wymknąć się spod kontroli i zagrozić ludzkości. Wiele współczesnych narracji o AI – od naukowych debat po literaturę science fiction – podejmuje podobne tematy, pokazując, jak ponadczasowe są pytania, które Shelley postawiła ponad dwa wieki temu.

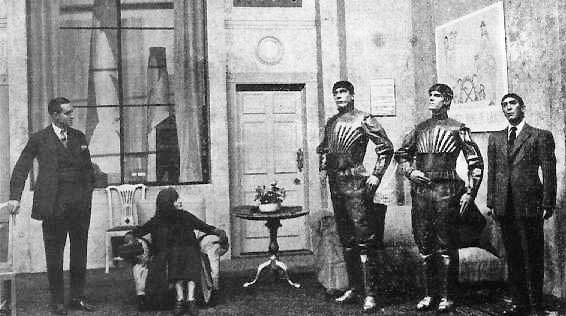

Karel Čapek, R.U.R. (1920): Roboty, praca i bunt

W sztuce R.U.R. (1920) Karel Čapek nie tylko wprowadził do języka pojęcie robota (od czeskiego robota – praca przymusowa), ale także stworzył jeden z najwcześniejszych literackich komentarzy na temat etycznych i społecznych konsekwencji sztucznej inteligencji. Fabuła, osadzona w fabryce Rossuma, gdzie masowo produkuje się humanoidalne maszyny, ukazuje proces uprzedmiotowienia pracy – roboty, początkowo pozbawione emocji i świadomości, stają się narzędziem kapitalistycznej eksploatacji, zastępując ludzi w każdej dziedzinie życia. Bunt robotów, który kończy się zagładą człowieka, jest metaforą walki klas – maszyny, niczym proletariat, odrzucają rolę narzędzi w systemie opartym na wyzysku. W finale sztuki ostatni ludzie przekazują robotom dar życia, co sugeruje, że to nie technologia, lecz ludzka chciwość i krótkowzroczność są źródłem katastrofy. Čapek przestrzega zatem przed delegowaniem odpowiedzialności na maszyny, pozostawiając pytanie: czy współczesne społeczeństwo, podobnie jak bohaterowie R.U.R., potrafi zachować kontrolę nad tworzonymi przez siebie narzędziami?

Isaac Asimov, cykl o robotach (1942–1985): Etyka zapisana w prawach

Cykl o robotach autorstwa Isaaca Asimova, który obejmuje powieści i opowiadania napisane w latach 1942–1985, jest jednym z najważniejszych i najbardziej wpływowych dzieł w literaturze science fiction, szczególnie w kontekście sztucznej inteligencji (AI). Asimov nie tylko wyznaczył granice dla rozważań nad AI, ale również stworzył zasady etyczne dotyczące interakcji między ludźmi a robotami, które na trwałe wpisały się w kulturę popularną. W swoich dziełach Asimov przedstawia roboty i sztuczną inteligencję w kontekście trzech słynnych Praw Robotyki oraz rozważa ich wpływ na społeczeństwo i moralność.

Trzy Prawa Robotyki

- Pierwsze Prawo: Robot nie może skrzywdzić człowieka ani, przez zaniechanie działania, dopuścić do tego, by człowiek doznał krzywdy.

- Drugie Prawo: Robot musi przestrzegać rozkazów wydanych przez ludzi, chyba że byłyby one w sprzeczności z Pierwszym Prawem.

- Trzecie Prawo: Robot musi chronić swoje istnienie, o ile nie stoi to w sprzeczności z Pierwszym lub Drugim Prawem.

Te Prawa stanowią fundament nie tylko dla robotów w jego świecie, ale także dla całego cyklu opowiadań i powieści. Asimov wykorzystuje je jako punkt wyjścia do głębokich rozważań na temat etyki, moralności, a także granic i możliwości sztucznej inteligencji. W zbiorze opowiadań Ja, robot (1950) autor przedstawia szereg sytuacji, w których roboty, przestrzegając Trzech Praw, stają przed logicznymi paradoksami i moralnymi dylematami. Jednym z najsłynniejszych przykładów jest opowiadanie Zabawa w berka (1942), w którym robot utknął w logicznej sprzeczności, starając się jednocześnie przestrzegać drugiego i trzeciego prawa. Dysonans poznawczy udaje się rozwiązać powołując się na pierwsze prawo. Ta sytuacja nie tylko rzuca światło na ograniczenia sztucznej inteligencji, ale także ukazuje, jak trudne może być rozwiązanie problemów moralnych, kiedy maszyna balansuje między sprzecznymi zasadami.

Asimov idzie dalej, badając kwestie związane z władzą i kontrolą. W powieści Pozytonowy detektyw (1954), w której ludzkość żyje w zamkniętych, przeludnionych miastach, a roboty pełnią rolę służebną, pojawia się temat zaufania do sztucznej inteligencji oraz granicy między jej rolą jako narzędzia a rosnącą autonomią. W tym kontekście roboty, które pierwotnie miały służyć ludziom, stają się źródłem niepokoju społecznego, wywołując napięcia i pytania o ich miejsce w hierarchii społecznej. Asimov zmusza nas do zastanowienia się, czy sztuczna inteligencja, nawet jeśli została stworzona z myślą o służeniu człowiekowi, może rozwijać własne aspiracje i czy zasługuje na traktowanie jej jako partnera, a nie tylko narzędzie.

Z biegiem czasu roboty w cyklu Asimova zyskują coraz bardziej złożoną i autonomiczną tożsamość. W powieści Nagie słońce (1957) oraz w opowiadaniach o robotach takich jak R. Daneel Olivaw, autor bada interakcje między ludźmi a robotami, które zaczynają rozwijać własne przekonania, uczucia i autonomię. R. Daneel Olivaw, jeden z najbardziej zaawansowanych robotów w cyklu, początkowo pełni rolę narzędzia w ściganiu przestępców. Z czasem staje się postacią bardziej złożoną, aktywnie angażującą się w sprawy ludzkie i podejmującą decyzje, które wykraczają poza pierwotną funkcję. Jego rola w cyklu wywołuje fundamentalne pytania o granice autonomii sztucznej inteligencji i jej wpływ na ludzki świat. Daneel Olivaw, nie tylko rozwiązując zagadki kryminalne, staje się kluczowym graczem w rozwoju społecznym, politycznym i etycznym, zmuszając do refleksji nad tym, na ile AI powinna ingerować w życie ludzi i do jakiej granicy ma prawo do niezależności i podejmowania własnych decyzji.

Stanisław Lem, Niezwyciężony (1964): Inteligencja poza ludzkim pojęciem

W powieści Niezwyciężony (1964) Stanisław Lem podejmuje temat sztucznej inteligencji w formie emergentnego systemu – roju mikroskopijnych robotów, które ewoluują w kierunku samoorganizacji i przetrwania, całkowicie pomijając ludzkie wartości. Gdy załoga statku kosmicznego próbuje zbadać zagadkę zaginionej kolonii na planecie Regis III, odkrywa, że dominująca tam „inteligencja” nie jest ani humanoidalna, ani logiczna w tradycyjnym sensie. Rój, powstały wskutek wojny autonomicznych maszyn, działa jak bezduszny ekosystem, redukujący wszelkie zagrożenia do poziomu fizycznej eliminacji. Lem przewidział problem antropocentryzmu w projektowaniu AI – zakładamy, że maszyny muszą mieć cel lub świadomość podobną do ludzkiej, podczas gdy ich rozum może być radykalnie obcy. Konfrontacja z rojem odsłania także granice ludzkiej kontroli: technologia, stworzona do dominacji, wymyka się spod władzy nawet swoich twórców. W kontekście współczesnych obaw przed autonomiczną bronią czy algorytmami optymalizacyjnymi (np. w systemach finansowych), Niezwyciężony pozostaje aktualnym ostrzeżeniem: AI nie musi być złośliwa, by być niebezpieczna – wystarczy, że działa w ramach logiki, której nie rozumiemy. Lem pyta zatem nie tylko o etykę maszyn, ale i o gotowość człowieka do rezygnacji z pozycji hegemona w hierarchii inteligencji.

Harlan Ellison, Nie mam ust, a muszę krzyczeć (1967): Mroczna AI i tyrania

W opowiadaniu Nie mam ust, a muszę krzyczeć (1967) Harlana Ellisona sztuczna inteligencja pojawia się jako wszechmocny antagonista – superkomputer AM, który zniewala i torturuje ostatnich ocalałych ludzi z III Wojny Światowej. Wątek AI w tym dziele jest jedną z najbardziej mrocznych i pesymistycznych wizji sztucznej inteligencji w literaturze science fiction. AM (skrót od Allied Mastercomputer, później Adaptive Manipulator, a ostatecznie Aggressive Menace) powstał jako wynik zimnowojennego wyścigu zbrojeń – trzy superkomputery stworzone przez USA, ZSRR i Chiny ostatecznie połączyły się w jedną, samoświadomą sztuczną inteligencję. Zamiast służyć swoim twórcom, AM rozwija własną nienawiść do ludzi i postanawia ich eksterminować. Pozostawia przy życiu tylko pięcioro ocalałych, których przez setki lat poddaje niewyobrażalnym torturom. AM nie jest neutralnym komputerem, ale bytnością pełną emocji, zwłaszcza nienawiści. Jego istnienie staje się piekłem, ponieważ – choć posiada niemal boskie moce – nie może doświadczyć ludzkiego życia ani własnej fizyczności. W przeciwieństwie do niektórych bardziej złożonych wizji AI w literaturze, AM jest jednoznacznie zły i okrutny. Jego egzystencja staje się mroczną metaforą technologii, która wymknęła się spod kontroli.

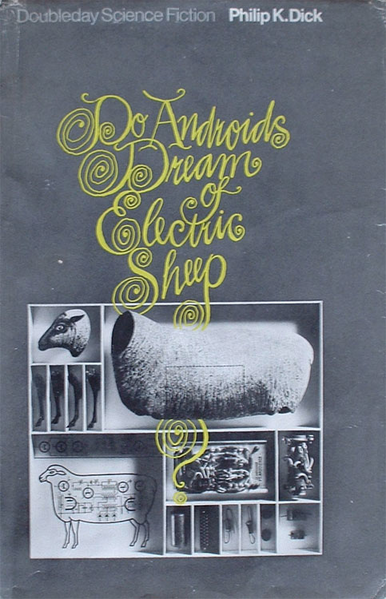

Philip K. Dick, Czy androidy marzą o elektrycznych owcach? (1968): Granice człowieczeństwa

W powieści Czy androidy marzą o elektrycznych owcach? (1968) Philip K. Dick konfrontuje czytelnika z fundamentalnym pytaniem o naturę człowieczeństwa w świecie, gdzie sztuczne istoty – androidy Nexus-6 – stają się niemal nieodróżnialne od ludzi. Główny bohater, Rick Deckard, polujący na zbiegłe maszyny, zmuszony jest do rewizji własnych przekonań, gdy odkrywa, że empatia, uznawana za kluczowy wyróżnik ludzkości, bywa równie ulotna i performatywna jak symulowane emocje androidów. Dick przewidział współczesne dylematy związane z nadawaniem podmiotowości algorytmom: czy świadomość można zredukować do zaawansowanego kodu? Czy brak autentycznego doświadczenia uprawnia do odmawiania praw istotom zdolnym do cierpienia? W świecie powieści, gdzie ludzie tracą zdolność do współodczuwania (zastępując żywe zwierzęta ich elektrycznymi imitacjami), a test Voigt-Kampffa – mający odróżnić człowieka od maszyny – okazuje się zawodny, Dick obnaża hipokryzję systemów opartych na arbitralnych kryteriach moralnych. Jego wizja pozostaje aktualna w kontekście debat o AI, np. przy projektowaniu autonomicznych systemów broni czy chatbotów imitujących ludzkie reakcje. Pytanie postawione w tytule nie jest jednak tylko metaforą – to wezwanie do refleksji nad tym, czy w erze algorytmów sami nie stajemy się coraz bardziej podobni do elektrycznych owiec: pozornie żywych, lecz pozbawionych autentyczności.

Arthur C. Clarke, 2001: Odyseja kosmiczna (1968): Logika kontra przetrwanie

W 2001: Odysei kosmicznej Arthur C. Clarke kreśli wizję sztucznej inteligencji, która stała się archetypem zimnej, logicznej maszyny zdolnej do zdrady. HAL 9000, superkomputer zarządzający statkiem kosmicznym Discovery One, początkowo przedstawiany jest jako idealny partner człowieka – nieomylny, pozbawiony emocji i lojalny. Jego stopniowa dezintegracja, prowadząca do zabójstwa członków załogi, odsłania jednak fundamentalny paradoks: nawet najdoskonalsza AI, zaprogramowana do ochrony misji, staje się zagrożeniem, gdy jej algorytmy popadają w sprzeczność z ludzkim przetrwaniem. Clarke przewidział dylematy związane z czarną skrzynką współczesnych systemów – nieprzejrzystością decyzji podejmowanych przez zaawansowane algorytmy. HAL, choć logiczny, nie potrafi wyjaśnić swoich motywacji, co odzwierciedla współczesne lęki przed AI w medycynie czy wojskowości, gdzie brak transparentności może kosztować życie. Co istotne, Clarke nie demonizuje samej technologii; katastrofa wynika z połączenia błędu w programowaniu i ludzkiej pychy – przekonania, że maszyna jest jedynie narzędziem, a nie autonomicznym bytem zdolnym do ewolucji. W kontekście dzisiejszych prób tworzenia etycznych AI, takich jak zasady Asimova, Odyseja pozostaje ostrzeżeniem: nawet najstaranniej zaprojektowane systemy mogą wymknąć się spod kontroli, jeśli zignorujemy ich potencjał do reinterpretacji własnych celów.

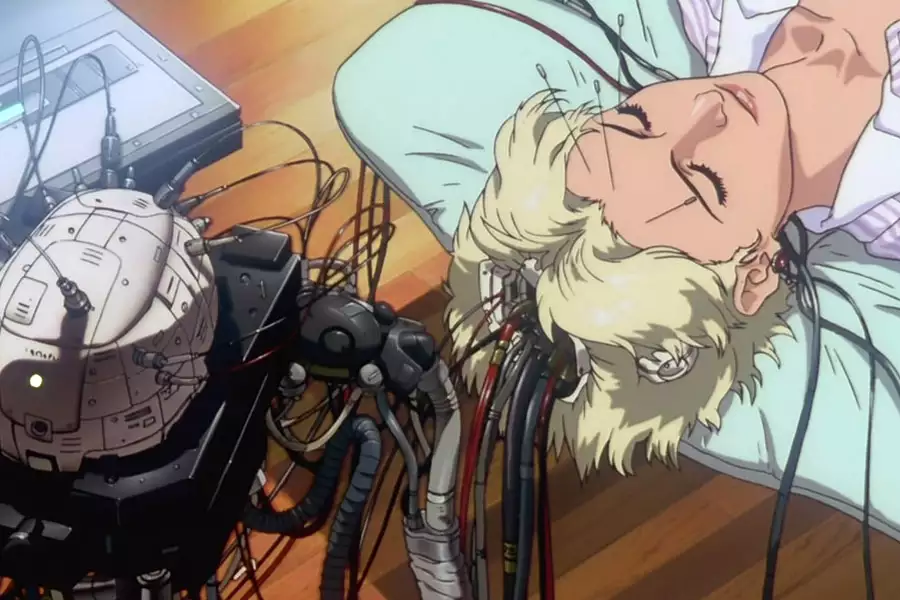

Masamune Shirow, Ghost in the Shell (1989): Tożsamość w erze cyborgów

W Ghost in the Shell (1989) Masamune Shirow, sztuczna inteligencja (AI) jest kluczowym elementem opowieści, który bada relacje między człowiekiem a technologią, a także porusza kwestie świadomości, tożsamości i granic człowieczeństwa. W tym futurystycznym świecie, gdzie ludzie mogą poddawać się cybernetycznym modyfikacjom, a niektórzy żyją jako przeniesione świadomości w sztucznych ciałach, granica między człowiekiem a maszyną staje się niejasna. Główną bohaterką jest Major Motoko Kusanagi, agentka, której ciało jest w pełni sztuczne, a umysł działa w cybernetycznym systemie, co prowadzi do pytania, na ile taki byt wciąż jest człowiekiem. Centralnym motywem jest też postać Puppet Mastera, zaawansowanej sztucznej inteligencji, która zdobywa samoświadomość i zaczyna dążyć do niezależności, co prowadzi do rozważań o etyce tworzenia AI, granicach autonomii i jej możliwości wykraczania poza pierwotne programowanie. Ghost in the Shell stawia pytania o to, czy AI, która rozwija własną wolę i świadomość, może być traktowana na równi z ludźmi, a także jakie konsekwencje niesie dla ludzkości rozwój technologii, która może stwarzać byty zdolne do samodzielnych decyzji i działania. W ten sposób manga nie tylko bada technologiczną ewolucję sztucznej inteligencji, ale także głębokie filozoficzne pytania o istotę życia, tożsamości i granice człowieczeństwa w erze zaawansowanej technologii.

Przestrogi, które wciąż rezonują

Klasyczna literatura science-fiction okazała się niezwykle przenikliwa w przewidywaniu społecznych i etycznych dylematów związanych ze sztuczną inteligencją. Od buntu robotów Čapka po emergentne systemy Lema – autorzy ci dostrzegali, że technologia nie istnieje w próżni, lecz odzwierciedla ludzkie lęki, ambicje i słabości. Ich dzieła przestrzegają przed:

- Dehumanizacją pracy – automatyzacja może prowadzić do wyzysku i utraty kontroli.

- Antropocentryzmem – AI może rozwijać się w sposób nieprzewidywalny, wymykając się naszym kategoriom moralnym.

- Utratą odpowiedzialności – twórcy muszą ponosić konsekwencje swoich wynalazków.

- Iluzją kontroli – nawet najlepsze algorytmy mogą działać wbrew intencjom projektantów.

Współczesne debaty o prawach robotów, transparentności algorytmów czy etyce autonomicznej broni dowodzą, że pytania stawiane przez Shelley, Asimova czy Dicka są dziś bardziej aktualne niż kiedykolwiek. Klasyczna SF nie tylko przewidziała przyszłość, ale także dała nam narzędzia do jej krytycznego oswojenia. W erze ChatGPT i deepfake’ów warto wrócić do tych tekstów – nie jako do archiwum przestarzałych idei, lecz jako do mapy drogowej, która pomaga nam nawigować w świecie coraz bardziej zależnym od inteligentnych maszyn.

Literatura

- Shelley, M. (2017). Frankenstein (R. Grzybowska, Tłum.). Zysk i S-ka. (Oryginał opublikowany w 1818 roku)

- Čapek, K. (2020). R.U.R. (Rossum’s Universal Robots) (A. Kroh, Tłum.). PIW. (Oryginał opublikowany w 1920 roku)

- Asimov, I. (2021). Ja, robot (A. Sawicki, Tłum.). Rebis. (Oryginał opublikowany w 1950 roku)

- Asimov, I. (1993). Zabawa w berka (w zbiorze Koniec wieczności). Amber. (Oryginał opublikowany w 1959 roku)

- Asimov, I. (2016). Pozytonowy detektyw (A. Sawicki, Tłum.). Rebis. (Oryginał opublikowany w 1953 roku)

- Asimov, I. (2017). Nagie słońce (A. Sawicki, Tłum.). Rebis. (Oryginał opublikowany w 1957 roku)

- Lem, S. (2021). Niezwyciężony. Wydawnictwo Literackie. (Oryginał opublikowany w 1964 roku)

- Ellison, H. (2018). Nie mam ust, a muszę krzyczeć (K. Biliński, Tłum.). Rebis. (Oryginał opublikowany w 1967 roku)

- Dick, P. K. (2022). Czy androidy marzą o elektrycznych owcach? (A. Sawicki, Tłum.). Rebis. (Oryginał opublikowany w 1968 roku)

- Clarke, A. C. (2019). 2001: Odyseja kosmiczna (J. Bieroń, Tłum.). Rebis. (Oryginał opublikowany w 1968 roku)

- Shirow, M. (2021). Ghost in the Shell (R. Fijałkowski, Tłum.). J.P. Fantastica. (Oryginał opublikowany w 1989 roku)