Muzyka generowana przez sztuczną inteligencję staje się coraz bardziej obecna w kulturze, często nieodróżnialna od dzieł ludzkich kompozytorów. To rodzi nowe pytania o transparentność, prawa autorskie i ochronę twórczości. Jak rozpoznać utwór stworzony przez algorytm? Jak skutecznie oznaczać takie treści na platformach streamingowych i w katalogach muzycznych? W tym tekście przyglądamy się aktualnym wyzwaniom, najnowszym technologiom oraz inicjatywom mającym na celu wprowadzenie jasnych zasad znakowania i rozpoznawania muzyki AI.

Gdy maszyna nauczy się słuchać tak jak człowiek, zaczyna też tworzyć muzykę, która trafia do ludzkiej wrażliwości. François Pachet, pionier AI w muzyce

Wraz z rosnącą popularnością sztucznej inteligencji w procesie twórczym, coraz więcej utworów muzycznych powstaje z udziałem algorytmów – a nierzadko są one generowane w całości przez AI. Choć technologia ta otwiera nowe możliwości dla artystów, producentów i słuchaczy, stawia również przed branżą muzyczną szereg istotnych wyzwań. Jednym z najpilniejszych jest kwestia identyfikacji oraz oznaczania treści stworzonych przez AI. Jak rozpoznać, że dany utwór został wygenerowany przez maszynę? Czy odbiorca ma prawo wiedzieć, kto – a może co – stoi za powstaniem danego dzieła?

W niniejszym wpisie przyjrzymy się problemowi znakowania muzyki generowanej przez AI – zarówno od strony technologicznej, jak i prawnej. Zastanowimy się, jakie mechanizmy mogą pomóc w skutecznym rozpoznawaniu takich utworów, jakie ryzyka niesie brak transparentności, oraz jakie rozwiązania są już dziś wdrażane w branży muzycznej i legislacyjnej. W świecie, w którym granice między twórczością człowieka a maszyny coraz bardziej się zacierają, przejrzystość i odpowiednie oznaczanie treści stają się kluczowe – nie tylko dla twórców i odbiorców, ale też dla całego systemu ochrony praw autorskich.

Muzyka generowana przez sztuczną inteligencję nie powstaje w próżni – za każdym „utworem” wygenerowanym przez algorytm stoi złożony system technologiczny, który analizuje dane, uczy się wzorców i tworzy nowe kompozycje. Choć dla słuchacza efekt może brzmieć jak dzieło ludzkiego kompozytora, to w rzeczywistości powstaje on dzięki zastosowaniu nowoczesnych narzędzi z pogranicza uczenia maszynowego, przetwarzania języka naturalnego, teorii muzyki i inżynierii dźwięku.

1. Technologie do tworzenia AI-muzyki

Rozwój muzyki generowanej przez sztuczną inteligencję opiera się na dynamicznym postępie w dziedzinie uczenia maszynowego oraz przetwarzania sygnałów dźwiękowych. Tworzenie muzyki przez AI to nie tylko komponowanie sekwencji nut, ale również odwzorowanie stylu, struktury i ekspresji charakterystycznej dla ludzkiej twórczości. Proces ten obejmuje zarówno analizę istniejących danych muzycznych (np. partytur, plików MIDI, nagrań audio), jak i ich syntezę w formie nowego utworu.

Współczesne technologie wykorzystywane do generowania muzyki AI dzielą się na kilka głównych kategorii. Pierwsza obejmuje modele sekwencyjne, które uczą się struktury i kolejności zdarzeń muzycznych. Druga to modele transformacyjne i multimodalne, zdolne do tworzenia muzyki na podstawie tekstu, stylu czy określonych instrukcji. Trzecia grupa obejmuje technologie syntezy dźwięku, które pozwalają na wygenerowanie końcowego, realistycznego brzmienia audio.

Poniżej przedstawione są najważniejsze typy architektur sieci neuronowych oraz systemów generatywnych, które zrewolucjonizowały podejście do tworzenia muzyki przez sztuczną inteligencję:

Sieci neuronowe – RNN, LSTM i GRU

Na początku rozwoju AI w muzyce wykorzystywano tzw. rekurencyjne sieci neuronowe (Recurrent Neural Networks – RNN), które dobrze sprawdzają się w analizie danych sekwencyjnych – takich jak nuty w melodii czy akordy w progresji harmonicznej.

Z czasem ich miejsce zaczęły zajmować bardziej zaawansowane architektury:

- LSTM (Long Short-Term Memory) – lepiej „zapamiętują” długoterminowe zależności w sekwencjach dźwięków.

- GRU (Gated Recurrent Units) – lżejsze alternatywy dla LSTM, również wykorzystywane do generowania nut i motywów melodycznych.

Te sieci potrafią „uczyć się stylu” danego gatunku lub kompozytora i tworzyć muzykę zgodną z danym wzorcem.

Modele transformacyjne (Jukebox, MusicLM, AudioCraft)

Zaawansowane modele generujące muzykę z tekstu lub danych audio. Tworzą kompletne utwory z wokalem, stylem i strukturą, przypominające produkcje ludzkich twórców.

Synteza dźwięku (WaveNet, GAN, modele dyfuzyjne)

Generują realistyczne brzmienie audio na podstawie danych wygenerowanych przez AI. Umożliwiają tworzenie gotowych do odsłuchu plików muzycznych.

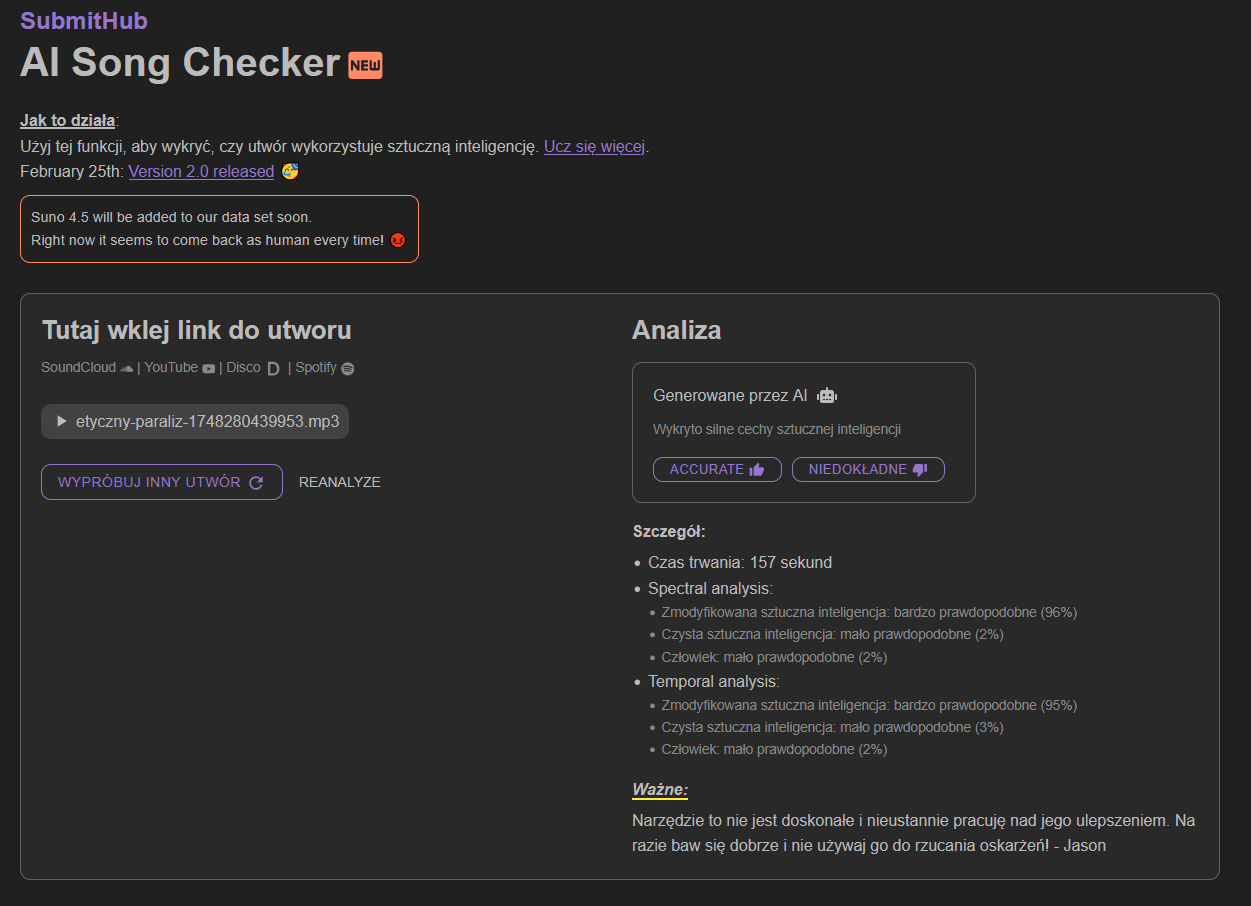

Przykładowa muzyka wygenerowana przy pomocy https://suno.com/home.

Wykorzystany prompt:

Stwórz muzkę epicką o etycznych problemach AI. Zadbaj o mocny bas i szybkie tempo. Głoś musi być basowy, ciężki, rockowy, jak chór wikingów.

2. Charakterystyka muzyki generowanej przez AI

Muzyka generowana przez sztuczną inteligencję coraz częściej dorównuje jakością utworom stworzonym przez człowieka, co rodzi zarówno fascynację, jak i wyzwania analityczne. Analiza charakterystyki muzyki AI obejmuje zarówno aspekty techniczne, jak i estetyczne, pozwalając zrozumieć, czym wyróżniają się kompozycje algorytmiczne i dlaczego ich rozpoznanie staje się coraz trudniejsze.

Struktura utworów generowanych przez AI

Utwory tworzone przez algorytmy generatywne zwykle opierają się na analizie ogromnych zbiorów danych muzycznych, co umożliwia AI generowanie złożonych form muzycznych. Struktura takich utworów może być bardzo różnorodna – od prostych sekwencji opartych na powtarzalnych motywach po rozbudowane aranżacje imitujące klasyczne formy muzyczne np. zwrotka-refren, forma sonatowa.

Mimo możliwości tworzenia zaawansowanych kompozycji, muzyka AI często wykazuje pewne charakterystyczne cechy strukturalne, takie jak:

- Wyraźna powtarzalność fraz muzycznych

- Mniej zróżnicowane zmiany dynamiczne i harmoniczne,

- Sztuczna „czystość” aranżacji – rzadziej pojawiają się nieregularności typowe dla twórczości ludzkiej (np. niestandardowe zmiany tempa, drobne błędy wykonawcze).

Oryginalność i kreatywność

Jednym z kluczowych wyzwań jest ocena oryginalności muzyki AI. Algorytmy generatywne zwykle działają poprzez miksowanie stylów, motywów i rozwiązań znanych z analizowanych baz danych.

- Muzyka AI może być bardzo „stylowa” i dobrze wpisywać się w wybrany gatunek (np. jazz, klasyka, pop), ale często brakuje jej unikatowego charakteru czy „osobowości twórcy”.

- Ograniczona jest zdolność do eksperymentowania z konwencją – AI generuje utwory na podstawie statystycznej analizy trendów, rzadziej przełamując utarte schematy lub tworząc coś zupełnie nowego.

Plagiaty i powtarzalność – choć AI rzadko dosłownie kopiuje fragmenty istniejących utworów, generowane kompozycje bywają do siebie podobne, zwłaszcza w obrębie tego samego modelu lub stylu.

3. Wyzwania w identyfikacji treści generowanych przez AI

Wraz z dynamicznym rozwojem technologii generatywnej, identyfikacja muzyki stworzonej przez sztuczną inteligencję (AI) staje się coraz bardziej złożonym zadaniem. Utwory generowane przez modele takie jak Jukebox (OpenAI), MusicLM (Google) czy Riffusion nie tylko przypominają muzykę tworzoną przez człowieka, ale coraz częściej osiągają porównywalną jakość, zarówno pod względem estetycznym, jak i technicznym. Ta sytuacja niesie za sobą szereg wyzwań – zarówno technicznych, jak i społeczno-prawnych – związanych z ich wykrywaniem i jednoznaczną identyfikacją.

Brak charakterystycznych cech

Jednym z głównych problemów w identyfikacji muzyki generowanej przez AI jest brak jednoznacznych, charakterystycznych cech odróżniających ją od twórczości ludzkiej. Zaawansowane modele potrafią generować skomplikowane struktury rytmiczne, harmoniczne i melodyczne, często imitując konkretne style muzyczne lub twórczość wybranych artystów. W przypadku muzyki instrumentalnej lub elektronicznej odróżnienie utworu wygenerowanego przez AI od ludzkiej kompozycji może być praktycznie niemożliwe bez dostępu do metadanych lub informacji o procesie tworzenia.

Brak standardu oznaczeń i metadanych

Obecnie nie istnieje uniwersalny standard znakowania muzyki generowanej przez AI. W wielu przypadkach wygenerowane utwory są publikowane bez jakichkolwiek informacji o ich pochodzeniu. Brakuje ujednoliconych metadanych, które pozwalałyby łatwo określić, czy dany utwór został stworzony przez człowieka, czy przez algorytm. Nawet jeśli twórca wykorzystał AI jako narzędzie pomocnicze, trudno jednoznacznie ustalić stopień udziału systemu generatywnego.

Zacieranie się granicy twórczości hybrydowej

Współczesna produkcja muzyczna często opiera się na współpracy człowieka z AI, np. poprzez wykorzystanie modeli generatywnych do tworzenia szkiców, harmonii lub rytmiki, które następnie są przekształcane i rozwijane przez kompozytora. Taka „twórczość hybrydowa” dodatkowo komplikuje proces identyfikacji, ponieważ nie można jednoznacznie zakwalifikować jej jako w pełni sztucznej ani w pełni ludzkiej. W efekcie pojawiają się pytania o to, czy i jak takie utwory powinny być identyfikowane jako „AI-generated”.

Ograniczenia technologii wykrywających

Chociaż rozwijane są modele rozpoznające treści generowane przez AI (np. analizujące sygnatury akustyczne, regularności rytmiczne, nieorganiczne przejścia czy styl typowy dla algorytmów), ich skuteczność jest nadal ograniczona. Wysokiej jakości generacja potrafi „przekroczyć” próg wykrywalności, a sam proces weryfikacji może być czasochłonny i kosztowny. Dodatkowo, technologie wykrywania mogą być obchodzone poprzez edycję wygenerowanego materiału, np. remiksowanie lub przekształcanie tempa i tonacji.

4. Znaczenie i rola znakowania treści generowanej przez AI

W kontekście rosnącego udziału sztucznej inteligencji w produkcji muzyki, pojawia się pilna potrzeba wprowadzenia skutecznych mechanizmów znakowania treści generowanych przez algorytmy. Znakowanie (ang. tagging, watermarking, flagging) pełni kilka kluczowych funkcji – od informacyjnych po prawne i etyczne – i jest niezbędne dla zapewnienia przejrzystości, ochrony konsumentów oraz stabilności rynku muzycznego.

Transparentność dla słuchaczy i odbiorców

Znakowanie treści generowanej przez AI umożliwia odbiorcom świadome podejmowanie decyzji dotyczących konsumpcji treści. Użytkownicy powinni mieć prawo wiedzieć, czy utwór, którego słuchają, został stworzony przez człowieka, czy przez algorytm. Wprowadzenie odpowiedniego oznaczenia w metadanych lub interfejsie użytkownika (np. na platformie streamingowej) może zwiększyć zaufanie odbiorców do platformy i pomóc w walce z dezinformacją.

Ochrona praw autorskich i zapobieganie naruszeniom

Znakowanie ma również znaczenie z perspektywy prawnej. W sytuacjach, gdy utwory AI imitują istniejące dzieła lub style konkretnych artystów, pojawia się ryzyko naruszenia praw autorskich lub wizerunku twórcy. Jasne oznaczenie treści jako wygenerowanej przez AI może ograniczyć takie nadużycia oraz stanowić dowód w ewentualnych postępowaniach prawnych.

Wsparcie dla twórców i rynku muzycznego

Wprowadzenie systemów znakowania może także pomóc twórcom muzyki w konkurowaniu na rynku. Oznaczenie utworu jako „human-made” może stać się wartością dodaną w kontekście autentyczności i artystycznego wkładu. Jednocześnie transparentność co do pochodzenia utworów może zapobiec nadmiernemu zalewowi rynku treściami automatycznie generowanymi, które deprecjonują wartość twórczości ludzkiej.

Techniczne metody znakowania

W praktyce znakowanie może przyjąć różne formy. Jedną z nich jest digital watermarking – technika wbudowywania niewidocznych informacji w dane audio, które mogą być później wykryte za pomocą specjalnych narzędzi. Inne podejścia to wprowadzenie metadanych opisujących pochodzenie pliku lub jego źródło generacji (np. model, data, autor promptu). Trwają również prace nad standardami interoperacyjnymi dla AI-generated content (np. inicjatywa C2PA – Coalition for Content Provenance and Authenticity).

Etyczne aspekty znakowania

Z perspektywy etycznej, znakowanie to także kwestia odpowiedzialności twórców technologii oraz wydawców muzyki. Ukrywanie informacji o wykorzystaniu AI może prowadzić do manipulacji emocjami odbiorców lub zafałszowania przekazu artystycznego. Przejrzystość w tym zakresie sprzyja budowie etycznej relacji między technologią a kulturą.

5. Technologie i algorytmy wykrywania muzyki generowanej przez AI

Wraz z rozwojem sztucznej inteligencji i narzędzi do generowania muzyki pojawiła się potrzeba skutecznego rozróżniania utworów stworzonych przez AI od tych, które są efektem pracy ludzi. Odpowiednie algorytmy i technologie wykrywania odgrywają kluczową rolę w zapewnieniu przejrzystości, ochronie praw autorskich oraz budowaniu zaufania odbiorców do treści muzycznych. Wśród metod wykorzystywanych do detekcji muzyki generowanej przez AI wyróżnić można kilka głównych podejść.

Modele wykrywające cechy statystyczne

Jednym z podstawowych podejść do rozpoznawania muzyki AI jest analiza statystycznych właściwości sygnału dźwiękowego. Algorytmy tego typu badają m.in. rozkład częstotliwości, dynamikę, powtarzalność oraz inne cechy charakterystyczne dla utworów tworzonych przez maszyny. Przykładowo, utwory generowane przez AI mogą wykazywać nienaturalną regularność, ograniczoną różnorodność harmoniczną lub nietypowe rozkłady dynamiki, które odróżniają je od muzyki komponowanej przez ludzi.

Modele klasyfikacyjne audio

Wykorzystanie modeli klasyfikacyjnych, takich jak drzewa decyzyjne, maszyny wektorów nośnych (SVM) czy algorytmy uczenia głębokiego, umożliwia identyfikację utworów AI poprzez analizę wyodrębnionych cech akustycznych. Modele te uczone są na dużych zbiorach danych zawierających zarówno utwory generowane przez AI, jak i utwory stworzone przez ludzi. Kluczowe cechy obejmują m.in. spektrum częstotliwości, tempo, długość fraz, czy poziom złożoności rytmicznej.

Sieci neuronowe

Nowoczesne podejścia wykorzystują głębokie sieci neuronowe, takie jak konwolucyjne sieci neuronowe (CNN) czy rekurencyjne sieci neuronowe (RNN), do analizy struktury muzycznej na wyższym poziomie. Takie modele mogą wykrywać subtelne wzorce w aranżacji, harmonii i melodii, które często trudno jest zidentyfikować klasycznymi metodami statystycznymi. Sieci te są w stanie analizować całe fragmenty utworów, wyciągać reprezentacje semantyczne oraz klasyfikować je jako muzykę AI lub utwory ludzkie.

Przykłady narzędzi do wykrywania muzyki generowanej przez AI

DeepFake-o-meter for Music

To eksperymentalne narzędzie oparte na sieciach neuronowych, którego celem jest klasyfikacja utworów muzycznych jako “naturalne” (ludzkie) lub “syntetyczne” (AI). DeepFake-o-meter analizuje strukturę muzyczną oraz cechy akustyczne takie jak rozkład częstotliwości, tempo, powtarzalność motywów i złożoność rytmiczną. Narzędzie to jest przykładem wdrożenia technik, które wcześniej znalazły zastosowanie w detekcji deepfake’ów audio i wideo.

AI-generated Music Detector (Google Research, 2023)

Google prowadzi badania nad narzędziami do detekcji generatywnej muzyki, wykorzystującymi uczenie maszynowe do wyodrębniania charakterystycznych cech utworów tworzonych przez systemy typu MusicLM czy Jukebox. Algorytm analizuje szereg parametrów – od mikrostruktury brzmieniowej, przez analizę powtarzalności, po charakterystyczne artefakty powstające przy generowaniu przez AI.

6. Znakowanie i rozpoznawanie

Znakowanie (tagowanie, watermarking) oraz rozpoznawanie muzyki generowanej przez AI to nie tylko tematy badań naukowych, ale również realne wyzwania dla całego przemysłu muzycznego. W ostatnich latach wiele firm technologicznych, platform streamingowych oraz instytucji muzycznych podejmuje pierwsze kroki w zakresie praktycznego wdrożenia mechanizmów identyfikacji i oznaczania utworów AI. Poniżej przedstawiono kilka najważniejszych studiów przypadków i praktyk rynkowych.

Platformy streamingowe – podejście i wyzwania

Spotify

Spotify, jako największa platforma streamingowa na świecie, regularnie musi mierzyć się z pojawiającymi się w katalogu utworami generowanymi przez AI. W odpowiedzi na rosnącą popularność takich treści, firma wprowadziła pierwsze rozwiązania pozwalające oznaczać utwory AI – zarówno przez samych twórców, jak i algorytmicznie. Obecnie Spotify testuje system automatycznego wykrywania muzyki syntetycznej na podstawie metadanych dostarczanych przez agregatorów oraz zgłoszeń społeczności. Trwają również prace nad ujednoliceniem tagowania treści AI oraz informowaniem słuchaczy o pochodzeniu utworu.

YouTube Music

YouTube Music umożliwia oznaczanie treści AI poprzez stosowanie dedykowanych tagów w opisie utworu. Platforma, należąca do Google, wykorzystuje także algorytmy rozpoznawania generatywnego audio, aby wykrywać nieoznakowaną muzykę stworzoną przez AI – zwłaszcza w kontekście praw autorskich i monetyzacji. YouTube prowadzi program pilotażowy polegający na znakowaniu utworów generowanych przez systemy AI oraz ograniczaniu ich zasięgu w przypadku naruszeń zasad platformy.

Praktyki firm technologicznych rozwijających AI

OpenAI

OpenAI, twórca modeli takich jak Jukebox (muzyka) i Voice Engine (głos), aktywnie bada i wdraża systemy cyfrowego watermarkingu generowanych utworów. Każdy plik wyprodukowany przez wybrane modele AI może być opatrzony niewidocznym znakiem wodnym w sygnale audio, który nie wpływa na odbiór przez ludzkie ucho, a pozwala na jednoznaczną identyfikację źródła przy analizie specjalistycznym oprogramowaniem. OpenAI promuje również transparentność poprzez rekomendowanie oznaczania utworów AI w metadanych oraz informowanie użytkowników o pochodzeniu treści.

Google rozwija modele generatywne, takie jak MusicLM, oraz aktywnie współpracuje z przemysłem muzycznym, aby opracować wspólne standardy znakowania i wykrywania utworów AI. Przykładem jest inicjatywa implementacji otwartych protokołów metadanych, które ułatwiają wykrywanie i oznaczanie muzyki generowanej przez AI w dużych katalogach streamingowych. Google angażuje się także w badania nad automatyczną detekcją muzyki syntetycznej w usługach takich jak YouTube czy Google Play Music.

Meta (Facebook, Instagram)

Meta testuje rozwiązania oparte na AI do automatycznego rozpoznawania generatywnych treści audio i ich oznaczania na platformach społecznościowych. Firma prowadzi badania nad rozpoznawaniem specyficznych „sygnatur” generowanych przez własne modele oraz wdraża systemy, które informują użytkowników, gdy mają do czynienia z treścią stworzoną przez AI. Meta aktywnie uczestniczy w tworzeniu międzynarodowych standardów etycznych dla treści generowanych przez sztuczną inteligencję.

Przykłady branżowe i inicjatywy regulacyjne

Inicjatywy branżowe

Stowarzyszenia branżowe, takie jak IFPI (International Federation of the Phonographic Industry), zaczęły współpracować z firmami technologicznymi w zakresie wdrażania oznaczeń i systemów rozpoznawania muzyki AI. Celem jest zarówno ochrona praw autorskich, jak i transparentność wobec odbiorców muzyki. Coraz częściej w kontraktach wydawniczych pojawiają się zapisy o obowiązku informowania o użyciu AI w procesie twórczym.

Regulacje i rekomendacje

Na poziomie międzynarodowym powstają wytyczne dotyczące znakowania treści AI, takie jak rekomendacje Unii Europejskiej czy wytyczne UNESCO. Ich celem jest wprowadzenie obowiązku jasnego informowania odbiorców o pochodzeniu utworów oraz wsparcie rozwoju otwartych standardów technicznych i prawnych dla identyfikacji muzyki generowanej przez AI.

Podsumowanie praktycznych wyzwań

Choć pierwsze wdrożenia systemów znakowania i rozpoznawania muzyki AI już istnieją, to wciąż napotykają liczne wyzwania. Należą do nich m.in.:

- Brak jednolitych standardów w zakresie oznaczania i rozpoznawania utworów,

- Niewystarczająca skuteczność automatycznych algorytmów w obliczu coraz bardziej zaawansowanych generatorów AI,

- Problemy prawne i etyczne związane z klasyfikacją i oznaczaniem utworów,

- Potrzeba edukacji twórców oraz odbiorców na temat nowych technologii i ich konsekwencji.

Przemysł muzyczny znajduje się więc na początku drogi do stworzenia efektywnych i powszechnie akceptowanych rozwiązań w zakresie znakowania oraz rozpoznawania muzyki generowanej przez AI

7. Aspekty prawne i etyczne znakowania muzyki AI

W tym momencie, warto pochylić się również nad aspektem prawnym tego zagadnienia. W szczególności, w kontekście muzyki, istotne jest zrozumienie, jakie prawa przysługują twórcom i użytkownikom takich utworów.

AI jako twórca – obecny stan prawny

Zgodnie z obowiązującym prawem autorskim, ochronie podlegają utwory będące przejawem działalności twórczej o indywidualnym charakterze, ustalone w jakiejkolwiek postaci. Kluczowym elementem jest jednak fakt, że autorem może być wyłącznie człowiek. Oznacza to, że dzieła stworzone w całości przez AI, bez udziału człowieka, nie są uznawane za utwory w rozumieniu prawa autorskiego. Takie rezultaty pracy AI określane są mianem „wytworów” i nie podlegają ochronie prawnej, co oznacza, że znajdują się w domenie publicznej.

Ryzyko naruszenia praw autorskich

Choć wytwory AI nie są chronione prawem autorskim, istnieje ryzyko naruszenia praw, jeśli wygenerowany materiał jest identyczny lub bardzo podobny do już istniejącego utworu. AI uczy się na podstawie istniejących dzieł, co może prowadzić do niezamierzonego kopiowania chronionych elementów. W takim przypadku odpowiedzialność za naruszenie praw autorskich może spoczywać na użytkowniku narzędzia AI, zwłaszcza jeśli doszło do komercyjnego wykorzystania takiego wytworu.

Korzystanie z narzędzi AI – na co zwrócić uwagę

Przy korzystaniu z narzędzi AI ważne jest zapoznanie się z ich regulaminami. Niektóre platformy mogą zastrzegać sobie prawa do materiałów wprowadzanych przez użytkowników lub do wytworów generowanych przez AI. Użytkownicy powinni być świadomi, jakie uprawnienia przekazują właścicielom narzędzi oraz jakie są zasady odpowiedzialności za wykorzystanie wygenerowanych treści.

8. Wnioski i rekomendacje

Muzyka generowana przez AI staje się coraz trudniejsza do odróżnienia od twórczości ludzkiej, a jej obecność w przemyśle muzycznym dynamicznie rośnie. Zwiększa to potrzebę rozwoju skutecznych narzędzi do identyfikacji i znakowania utworów AI, zarówno w celu ochrony praw autorskich, jak i zapewnienia transparentności wobec odbiorców.

Rekomendacje:

- Rozwijanie i wdrażanie technologii znakowania (np. watermarking, metadane), w celu ułatwienia identyfikacji źródeł utworów muzycznych.

- Współpraca międzysektorowa (branża muzyczna, firmy technologiczne, regulatorzy), w celu wypracowania jednolitych standardów oznaczania muzyki AI.

- Zwiększanie świadomości twórców i odbiorców na temat obecności oraz możliwości rozpoznawania muzyki generowanej przez AI.

Kontynuacja badań naukowych nad nowymi algorytmami wykrywania oraz stałe monitorowanie rozwoju technologii.

Bibliografia:

- Briot, Jean-Pierre, Gaëtan Hadjeres, and François-David Pachet. Deep learning techniques for music generation. Vol. 1. Heidelberg: Springer, 2020.

- Pachet, François. „Musical virtuosity and creativity.” Computers and creativity. Berlin, Heidelberg: Springer Berlin Heidelberg, 2012. 115-146.

- Sturm, Bob L., et al. „Machine learning research that matters for music creation: A case study.” Journal of New Music Research 48.1 (2019): 36-55.

- EUROPEIA, COMISSÃO. „Proposal for a Regulation on a European approach for Artificial Intelligence.” Bruxelas: Comissão Europeia (2021).

- Nayar, Vilasini. „The Ethics of AI Generated Music: A Case Study on Suno AI.” GRACE: Global Review of AI Community Ethics 3.1 (2025).

- https://akademia.zaiks.org.pl/wiedza/czy-ai-moze-byc-autorem-copy

[…] poprzednim artykule skupiliśmy się na seks robotach w ogólności, a także na najpopularniejszej formie tego […]