1. Wprowadzenie

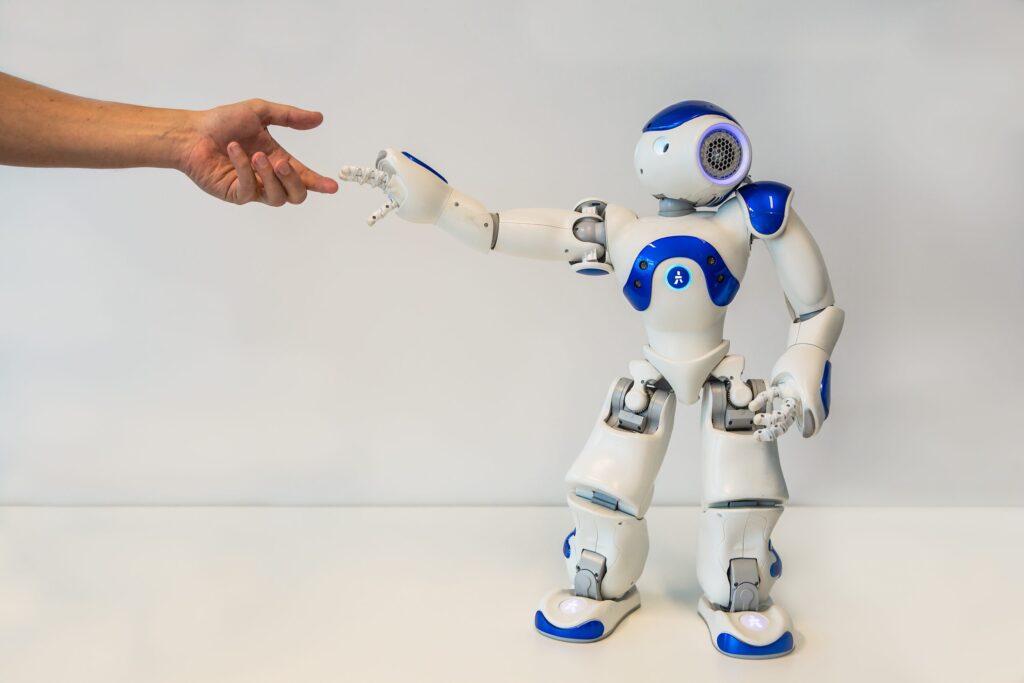

Roboty społeczne to maszyny zaprojektowane do interakcji z ludźmi w sposób naturalny i zrozumiały, często przypominający relacje międzyludzkie. W przeciwieństwie do robotów przemysłowych, które działają w ściśle kontrolowanych środowiskach, roboty społeczne funkcjonują w przestrzeniach codziennego użytku – takich jak domy, szkoły czy placówki opieki. Przykładami takich urządzeń są Pepper – humanoidalny robot rozpoznający emocje, Nao – mały edukacyjny robot używany m.in. w terapii dzieci z autyzmem, czy Care-O-bot, który pomaga osobom starszym w domowych obowiązkach.

Współdziałanie ludzi z robotami – znane jako Human-Robot Interaction (HRI) – staje się coraz ważniejszym elementem projektowania nowoczesnych technologii. HRI obejmuje zarówno komunikację werbalną, jak i niewerbalną, a jej celem jest stworzenie płynnej i bezpiecznej współpracy. W codziennym życiu może to oznaczać proste czynności, takie jak poproszenie robota o podanie butelki wody, przyniesienie przedmiotu z innego pokoju czy pomoc przy sprzątaniu. Choć z perspektywy człowieka są to gesty intuicyjne, dla robota wymagają zaawansowanego przetwarzania informacji, interpretacji kontekstu i planowania ruchu.

Podawanie przedmiotów, choć z pozoru proste, jest jednym z najbardziej złożonych zadań w interakcji fizycznej między człowiekiem a robotem. Wymaga nie tylko precyzyjnych działań mechanicznych, ale także zrozumienia intencji użytkownika, przewidywania jego reakcji oraz dostosowania tempa i siły działania. Złe wykonanie tego gestu może prowadzić do nieporozumień, niechęci użytkownika, a nawet do niebezpiecznych sytuacji.

Celem niniejszego artykułu jest omówienie strategii bezpiecznego wydawania poleceń i przekazywania przedmiotów robotom społecznym. Skupimy się na wyzwaniach HRI w kontekście fizycznej współpracy, przeglądzie metod komunikacji, modelach interakcji oraz dobrych praktykach. Poruszymy także kwestie etyczne i społeczne, związane z rosnącą obecnością robotów w naszym otoczeniu.

2. Kontekst i wyzwania HRI w zadaniach fizycznej współpracy

Różnica między robotami przemysłowymi a społecznymi

Roboty przemysłowe i roboty społeczne różnią się nie tylko wyglądem czy środowiskiem działania, ale przede wszystkim założeniami projektowymi i sposobem interakcji z otoczeniem. Robot przemysłowy – jak ramię robotyczne na linii montażowej – wykonuje precyzyjnie zaprogramowane czynności w ściśle kontrolowanych warunkach. Działa szybko, z dużą siłą i bez potrzeby interpretowania ludzkich emocji czy intencji. Co więcej, zwykle pracuje za fizycznymi barierami ochronnymi, które mają zapobiec kontaktowi z człowiekiem i zminimalizować ryzyko wypadków.

W odróżnieniu od tego, roboty społeczne są projektowane z myślą o bliskim, bezpośrednim kontakcie z ludźmi. Muszą poruszać się w otwartych, dynamicznych środowiskach – takich jak mieszkania, biura czy szkoły – i reagować na nieprzewidywalne zachowania użytkowników. Wymaga to od nich zupełnie innego podejścia do percepcji otoczenia, planowania ruchu oraz reagowania na bodźce społeczne, takie jak spojrzenie, ton głosu czy gest ręką. Nie chodzi już tylko o wykonanie zadania, ale o wykonanie go w sposób akceptowalny społecznie i bezpieczny.

Fundamentalną różnicą jest również cel interakcji: robot przemysłowy „współpracuje” z człowiekiem jedynie pośrednio, wykonując powtarzalne operacje w jego otoczeniu. Robot społeczny natomiast wchodzi z człowiekiem w relację, często na poziomie komunikacji niewerbalnej. Ta różnica przekłada się bezpośrednio na wyzwania konstrukcyjne. O ile robot przemysłowy może polegać na precyzyjnych czujnikach i powtarzalnych warunkach, robot społeczny musi dysponować elastycznymi algorytmami percepcji, które pozwalają mu „rozumieć” sytuację społeczną w czasie rzeczywistym. W zadaniach takich jak podawanie przedmiotów oznacza to konieczność m.in.:rozpoznania osoby, do której należy się zwrócić,

zrozumienia, czego dotyczy prośba, oceny bezpiecznego dystansu i momentu przekazania obiektu.

Bezpieczeństwo fizyczne i psychologiczne w HRI

W interakcji z robotami społecznymi bezpieczeństwo ma dwa wymiary: fizyczny i psychologiczny. Ten pierwszy dotyczy ochrony przed urazami – robot musi unikać kolizji, dostosowywać siłę chwytu i utrzymywać odpowiedni dystans. Dlatego wiele urządzeń wyposażanych jest w czujniki siły, kamery głębi i systemy wczesnego wykrywania przeszkód, jak np. Care-O-bot 4.

Bezpieczeństwo psychologiczne to z kolei poczucie komfortu i zaufania użytkownika. Nagłe ruchy, brak reakcji na sygnały niewerbalne czy zbyt bezpośrednie zachowanie mogą wywołać stres lub niechęć. Z tego względu projektuje się roboty, które komunikują swoje zamiary w sposób zrozumiały – np. poprzez światła, dźwięki czy mimikę, jak w przypadku robota Pepper.

Problemy percepcyjne i decyzyjne robotów – jak rozpoznają przedmioty i użytkowników

Aby robot mógł podać przedmiot, musi najpierw poprawnie zinterpretować otoczenie – rozpoznać człowieka, zidentyfikować obiekt i zrozumieć kontekst polecenia. Wydaje się to proste, ale dla maszyny oznacza to złożony proces przetwarzania danych z wielu czujników jednocześnie: kamer RGB-D, mikrofonów, lidarów czy sensorów dotykowych.

Wyzwania pojawiają się już na etapie wykrywania przedmiotów – robot musi rozpoznać ich kształt, kolor, położenie i orientację, często w warunkach zmiennego oświetlenia i z częściowo zasłoniętym widokiem. Problematyczna jest też identyfikacja osoby, która wydała polecenie, szczególnie w grupie. Systemy takie jak OpenPose czy MediaPipe pomagają w analizie postawy i gestów, ale nie są niezawodne.

Znaczenie kontekstu sytuacyjnego (np. dom, szpital, szkoła)

Zachowanie robota społecznego nie może być uniwersalne – musi być dostosowane do miejsca i sytuacji, w jakiej działa. Inaczej zachowuje się asystent w domu prywatnym, inaczej opiekun w szpitalu, a jeszcze inaczej pomocnik w klasie. Kontekst wpływa na tempo interakcji, rodzaj komunikatów i sposób przekazywania przedmiotów.

W warunkach domowych użytkownicy często oczekują swobodnej, „przyjacielskiej” współpracy. W szpitalu kluczowe stają się delikatność i przewidywalność – robot nie może zaskakiwać pacjenta ruchem czy dźwiękiem. W środowisku edukacyjnym liczy się za to prostota obsługi i odporność na chaotyczne otoczenie.

Kontekst sytuacyjny obejmuje nie tylko fizyczną przestrzeń, ale też intencje użytkownika, jego nastrój i potrzeby. Coraz więcej systemów stara się uwzględniać te czynniki, np. poprzez analizę mowy, ekspresji twarzy czy tonu głosu, jak robi to Furhat Robotics.

3. Sposoby wydawania poleceń – przegląd metod

Efektywna komunikacja z robotami społecznymi wymaga opracowania metod, które będą dla człowieka intuicyjne, a dla robota możliwe do jednoznacznej interpretacji. W kontekście podawania przedmiotów kluczowe jest, aby użytkownik mógł precyzyjnie zakomunikować, co, komu, kiedy i jak ma zostać podane. W tym celu stosuje się różnorodne sposoby wydawania poleceń – od głosu i gestów po aplikacje mobilne czy rozwiązania hybrydowe.

Wydawanie poleceń głosowych – zalety i ograniczenia

Mowa to jeden z najbardziej naturalnych sposobów komunikacji międzyludzkiej, dlatego wiele robotów społecznych wyposażono w systemy rozpoznawania mowy. Polecenia typu „podaj mi kubek” czy „przynieś mi książkę” są łatwe do wypowiedzenia i nie wymagają od użytkownika użycia rąk czy wzroku. Zaletą tego podejścia jest wygoda i dostępność, szczególnie w sytuacjach, gdy użytkownik ma ograniczoną mobilność (np. osoby starsze, pacjenci).

Ograniczeniem jest jednak podatność na błędy – szumy otoczenia, różnice akcentowe, nieprecyzyjna artykulacja czy brak kontekstu mogą utrudniać prawidłową interpretację wypowiedzi. Problemem są też niejednoznaczne sformułowania („podaj to”), które wymagają dodatkowej weryfikacji.

Wskazywanie ręką i gestami

Komunikacja niewerbalna – zwłaszcza wskazywanie ręką, skinienie głową czy wyciągnięcie dłoni – to istotny element interakcji z robotami. Gesty są intuicyjne i często towarzyszą mowie, wzmacniając jej znaczenie. Dzięki systemom wizyjnym i analizie postawy (np. OpenPose, Mediapipe), robot może rozpoznać kierunek wskazania, intencję użytkownika i obiekt zainteresowania.

Wyzwaniem jest jednak precyzyjne rozpoznawanie gestów w zmiennych warunkach oświetleniowych, przy zasłonięciu ciała lub gdy użytkownik nie wykonuje ich wystarczająco wyraźnie. Współczesne algorytmy potrafią analizować gesty w czasie rzeczywistym, ale nadal potrzebują doprecyzowania przez inne kanały komunikacyjne.

Interfejsy dotykowe i mobilne aplikacje

Dla osób preferujących bardziej „techniczne” formy komunikacji dostępne są interfejsy dotykowe – np. ekrany wbudowane w robota, panele sterujące lub aplikacje mobilne. Użytkownik może na nich wskazać konkretny przedmiot, osobę lub działanie z listy opcji.

Takie rozwiązania są precyzyjne, ale mniej naturalne – wymagają sięgnięcia po urządzenie, co może być kłopotliwe w dynamicznej sytuacji. Sprawdzają się jednak tam, gdzie ważna jest dokładność, np. w edukacji, opiece zdrowotnej czy pracy z osobami z zaburzeniami mowy.

Mieszane podejścia (multimodalne interakcje)

Największy potencjał w bezpiecznym i skutecznym wydawaniu poleceń mają tzw. interakcje multimodalne, łączące różne kanały komunikacji: głos, gest, dotyk i kontekst sytuacyjny. Przykładowo, użytkownik mówi „podaj mi kubek”, jednocześnie wskazując go ręką, a robot analizuje zarówno treść wypowiedzi, jak i kierunek gestu oraz pozycję obiektu w przestrzeni.

Multimodalność pozwala zredukować ryzyko nieporozumień i zwiększa elastyczność interakcji, ale wymaga zaawansowanego przetwarzania danych w czasie rzeczywistym. Systemy muszą integrować informacje z różnych sensorów i podejmować decyzje na podstawie niejednoznacznych lub sprzecznych sygnałów.

Problemy z niejednoznacznością i dwuznacznością poleceń

Niezależnie od wybranej metody, kluczowym wyzwaniem jest rozwiązywanie niejednoznaczności. Sformułowania typu „to”, „tamto”, „ten drugi” są zrozumiałe dla człowieka w kontekście danej sytuacji, ale dla robota – bez pełnego modelu otoczenia i intencji – mogą być mylące. Gest wykonany niedokładnie lub wypowiedź z pominięciem słowa-klucz może prowadzić do błędnej interpretacji.

Dlatego coraz częściej wprowadza się mechanizmy potwierdzenia – np. robot może zapytać „Czy chodziło ci o niebieski kubek?”, zanim wykona działanie. Inne podejścia obejmują nauczanie robota na podstawie przykładów, w których uczony jest rozpoznawania stylu komunikacji konkretnego użytkownika.

4. Strategie bezpiecznej interakcji przy przekazywaniu przedmiotów

Modele współdzielonej kontroli (shared autonomy)

Współdzielona kontrola to podejście, w którym człowiek i robot razem realizują zadanie, dzieląc się odpowiedzialnością za decyzje i działania. W kontekście podawania przedmiotów oznacza to, że robot nie działa całkowicie autonomicznie, lecz reaguje na sygnały użytkownika i umożliwia mu wpływ na przebieg interakcji. Przykładowo: użytkownik inicjuje polecenie, robot rozpoznaje przedmiot i zaczyna go podnosić, ale ostateczne przekazanie następuje dopiero po wyraźnym sygnale potwierdzającym, np. skinieniu głową lub kontakcie wzrokowym.

Takie podejście zwiększa bezpieczeństwo i przewidywalność – człowiek zachowuje kontrolę, a robot działa elastycznie w granicach określonych intencji użytkownika. Dzięki shared autonomy możliwe jest dostosowanie tempa, siły i sposobu działania do aktualnych warunków i potrzeb. To szczególnie ważne w sytuacjach wymagających precyzji, np. podczas podawania gorącego napoju lub delikatnego przedmiotu.

Strategie oparte na przestrzeni perypersonalnej i osobistej

Bezpieczne przekazywanie przedmiotów wymaga od robota respektowania tzw. przestrzeni perypersonalnej i osobistej człowieka. Przestrzeń perypersonalna to obszar bezpośrednio otaczający ciało – zasięg ramion, w którym człowiek naturalnie sięga po przedmioty. Przestrzeń osobista z kolei odnosi się do strefy komfortu psychicznego – zbyt bliskie podejście może wywołać dyskomfort lub stres.

Roboty społeczne powinny więc podawać obiekty w sposób, który nie narusza tych granic. Najczęściej oznacza to zatrzymanie ruchu w odpowiedniej odległości i „zawieszenie” obiektu w przestrzeni, umożliwiając użytkownikowi samodzielne jego odebranie. Takie podejście zwiększa poczucie kontroli i bezpieczeństwa.

Niektóre systemy dodatkowo personalizują zachowanie robota, ucząc się preferencji użytkownika co do dystansu czy dominującej ręki. Dzięki temu interakcja staje się nie tylko bezpieczna, ale też bardziej naturalna i komfortowa.

Oczekiwanie na sygnał potwierdzający (eye-contact, gest)

Jedną z kluczowych strategii bezpiecznego przekazywania przedmiotów przez robota jest aktywne oczekiwanie na tzw. sygnał potwierdzający ze strony użytkownika. W przeciwieństwie do automatycznego zakończenia ruchu, robot wstrzymuje się z oddaniem przedmiotu do momentu, aż odbierze jednoznaczny sygnał świadczący o gotowości człowieka do interakcji.

Takim sygnałem może być kontakt wzrokowy, delikatny gest ręką, skinienie głowy lub nawet krótkie słowo („tak”, „dzięki”). Dzięki zastosowaniu czujników wizyjnych i systemów śledzenia twarzy lub dłoni, robot potrafi wykryć, że użytkownik patrzy w jego stronę lub wyciąga rękę. To pozwala zminimalizować ryzyko przypadkowego „wepchnięcia” przedmiotu w osobę, która nie jest jeszcze gotowa na jego odebranie.

Mechanizmy rozpoznawania intencji i kontekstu

Aby interakcja z robotem była naprawdę bezpieczna i naturalna, maszyna musi nie tylko odbierać polecenia, ale też rozumieć intencje użytkownika oraz kontekst sytuacji. W praktyce oznacza to analizę nie tylko co zostało powiedziane lub zrobione, ale także dlaczego i w jakich warunkach.

Rozpoznawanie intencji może opierać się na analizie języka naturalnego, kierunku spojrzenia, postawy ciała, a także historii wcześniejszych interakcji. Przykładowo: jeśli użytkownik codziennie rano prosi o kubek z kawą, robot może sam przewidywać to zachowanie i przygotowywać się do jego realizacji. Jednocześnie – jeśli użytkownik nie patrzy w stronę robota lub zajmuje się inną czynnością – system może zinterpretować to jako brak gotowości i wstrzymać akcję.

Kontekst sytuacyjny obejmuje także elementy otoczenia – np. to, czy ktoś inny znajduje się blisko, czy przedmiot jest bezpieczny do podania (np. nie jest zbyt gorący), czy użytkownik ma wolne ręce. Integracja tych danych pozwala robotowi podejmować bardziej świadome decyzje i zmniejsza liczbę błędów wynikających z błędnej interpretacji.

Adaptacyjne tempo i siła chwytu – jak robot „wie”, kiedy puścić

Podanie przedmiotu to nie tylko kwestia jego chwycenia i wyciągnięcia ramienia. Równie ważne jest tempo, z jakim robot się porusza, oraz moment, w którym decyduje się puścić obiekt. Zbyt szybki ruch może zaskoczyć użytkownika, zbyt mocny chwyt – uniemożliwić odebranie przedmiotu, a zbyt wczesne puszczenie – spowodować jego upuszczenie.

Nowoczesne roboty społeczne wykorzystują czujniki siły i momentu obrotowego, które pozwalają im „wyczuć” moment, w którym człowiek przejmuje kontrolę nad obiektem. Jeśli użytkownik zaczyna delikatnie pociągać przedmiot, robot rejestruje zmianę nacisku i stopniowo rozluźnia uchwyt. Równocześnie analizowane są dane wizualne – np. ułożenie dłoni, kontakt wzrokowy, czy nawet mimika twarzy – aby potwierdzić, że interakcja przebiega zgodnie z oczekiwaniami.

Adaptacyjne tempo działania to z kolei sposób na dostosowanie się do tempa użytkownika – robot nie powinien działać szybciej niż potrzeba. Dzięki takim mechanizmom interakcja staje się bardziej płynna, a użytkownik ma poczucie większej kontroli nad sytuacją.

5. Przykłady zastosowania i dobre praktyki

Studia przypadków z badań naukowych lub przemysłu (np. roboty opiekuńcze, asystenci domowi)

Zadania związane z podawaniem przedmiotów są intensywnie testowane zarówno w laboratoriach badawczych, jak i w rzeczywistych środowiskach użytkowników. Jednym z popularniejszych przykładów jest robot asystujący Care-O-bot 4, opracowany przez Fraunhofer IPA. W testach z udziałem seniorów robot potrafił rozpoznać wskazany przedmiot (np. lek), przynieść go w bezpieczny sposób i podać w odpowiednim momencie, oczekując na wyciągnięcie ręki przez użytkownika.

Z kolei w badaniach z użyciem robota Tiago od PAL Robotics przeanalizowano, jak sposób przekazywania obiektu wpływa na poziom zaufania uczestników. Wyniki pokazały, że strategie bazujące na kontakcie wzrokowym i sygnale potwierdzającym zwiększały komfort użytkownika oraz zmniejszały liczbę nieporozumień.

W środowisku domowym interesujące próby prowadzi także Toyota z robotami HSR (Human Support Robot), które są w stanie rozpoznać konkretne obiekty z listy i dostarczyć je użytkownikowi na podstawie komendy głosowej i lokalizacji w przestrzeni.

Błędy i incydenty – czego uczą nas porażki

Choć projektanci robotów społecznych starają się minimalizować ryzyko, interakcje fizyczne – zwłaszcza związane z przekazywaniem przedmiotów – nadal bywają źródłem błędów i nieporozumień. W literaturze opisano przypadki, w których robot zbyt szybko puścił przedmiot, upuszczając go na podłogę, lub przeciwnie – utrzymał go zbyt długo, powodując niepotrzebne szarpnięcie. W skrajnych sytuacjach dochodziło do uderzenia użytkownika ramieniem robota, co choć niegroźne, potrafi skutecznie zniechęcić do dalszej interakcji.

Przykłady takie jak badania nad robotem HERB z Carnegie Mellon University pokazują, że drobne błędy – np. podanie przedmiotu z niewłaściwej strony – mogą znacząco wpłynąć na odbiór całego systemu. Użytkownicy deklarowali mniejsze zaufanie i większy stres, nawet jeśli technicznie zadanie zostało wykonane poprawnie.

6. Etyka i akceptacja społeczna

Zaufanie do robotów w kontekście fizycznej interakcji

Zaufanie to kluczowy element każdej interakcji człowiek–robot, zwłaszcza gdy dochodzi do kontaktu fizycznego, jak przy podawaniu przedmiotów. Użytkownik musi mieć pewność, że robot nie zrobi nic nieprzewidywalnego, nie naruszy jego przestrzeni osobistej ani nie wyrządzi krzywdy – nawet przypadkowo. To zaufanie buduje się stopniowo, na podstawie wcześniejszych doświadczeń, obserwacji zachowań robota oraz sposobu, w jaki reaguje on na ludzkie sygnały.

Badania pokazują, że przewidywalność i przejrzystość działań robota mają bezpośredni wpływ na poziom zaufania. Jeśli robot potrafi zasygnalizować swoje zamiary – np. za pomocą światła, gestu lub komunikatu głosowego – użytkownik czuje się bezpieczniej i bardziej komfortowo. Z kolei nieprzewidywalne ruchy, brak reakcji na błędy lub naruszanie przestrzeni osobistej mogą prowadzić do lęku lub całkowitego wycofania się z interakcji.

Dlatego etyczne projektowanie robotów społecznych obejmuje nie tylko kwestie techniczne, ale też psychologiczne – robot powinien działać w sposób, który wspiera poczucie bezpieczeństwa, kontroli i wzajemnego zrozumienia.

Kwestia odpowiedzialności za błąd – człowiek vs maszyna

W miarę jak roboty społeczne zyskują większą autonomię, coraz częściej pojawia się pytanie: kto ponosi odpowiedzialność, gdy coś pójdzie nie tak? Jeśli robot poda niewłaściwy przedmiot, upuści go lub przypadkowo uderzy użytkownika – czy winę ponosi konstruktor, operator, sam robot, a może użytkownik?

W praktyce odpowiedzialność za błąd zależy od stopnia autonomii systemu oraz sposobu jego wdrożenia. Gdy robot działa wyłącznie na podstawie ręcznie zaprogramowanych poleceń, łatwiej wskazać winnego – zwykle człowieka. Jednak w przypadku systemów uczących się, które adaptują się do zachowań użytkownika, granica odpowiedzialności zaczyna się zacierać.

Brak jasnych ram prawnych dotyczących takich sytuacji może budzić niepokój i wpływać na akceptację robotów w środowiskach codziennego użytku. Dlatego coraz częściej mówi się o potrzebie tworzenia tzw. audytowalnych algorytmów – takich, które nie tylko podejmują decyzje, ale też potrafią je uzasadnić. Przejrzystość działania i możliwość śledzenia „ścieżki decyzji” robota stają się istotnym elementem zarówno z punktu widzenia prawa, jak i zaufania społecznego.

Etyczne aspekty autonomii robota i decyzyjności

Autonomia robota oznacza jego zdolność do samodzielnego podejmowania decyzji na podstawie danych z otoczenia, wcześniejszych doświadczeń i ogólnych zasad działania. W kontekście interakcji fizycznej – jak podawanie przedmiotów – budzi to jednak istotne pytania etyczne: na ile robot powinien sam decydować, a kiedy musi uzyskać zgodę człowieka?

Zbyt duża autonomia może prowadzić do sytuacji, w której robot działa w sposób nieprzewidywalny lub niepożądany, np. zbliża się bez zaproszenia, podaje przedmiot bez zapytania, przerywa inną aktywność użytkownika. Z drugiej strony – zbyt silne ograniczenie autonomii obniża użyteczność systemu i czyni interakcję nieefektywną.

Etyczne projektowanie zakłada znalezienie równowagi między inicjatywą robota a kontrolą człowieka. Kluczowe jest tu wprowadzenie tzw. granic decyzyjnych – czyli warunków, po których spełnieniu robot może podjąć działanie, ale też mechanizmów wstrzymywania i cofania poleceń. Autonomia powinna być kontekstowa, zależna od osoby, sytuacji i poziomu ryzyka.

Kulturowe różnice w podejściu do interakcji z robotem

Kulturowe różnice wpływają również na preferencje dotyczące interakcji. W niektórych krajach – np. w Japonii czy Korei Południowej – akceptowane są bliskie dystanse interpersonalne oraz bardziej spontaniczne, „emocjonalne” zachowania robota, takie jak kiwanie głową, uśmiechanie się czy mówienie wysokim tonem głosu. Użytkownicy oczekują, że robot będzie „sympatyczny” i niemal towarzyski, nawet jeśli jego funkcjonalność jest ograniczona.

Z kolei w krajach takich jak Niemcy, Wielka Brytania czy Skandynawia częściej preferowane są roboty, które zachowują się formalnie, precyzyjnie komunikują swoje zamiary i utrzymują większy dystans fizyczny. Przekazywanie przedmiotów powinno odbywać się bez pośpiechu i bez zbędnych gestów – liczy się efektywność i przejrzystość interakcji.

W badaniach z robotem Pepper prowadzonych we Francji i Japonii zauważono, że francuscy użytkownicy woleli mniej ekspresyjne zachowanie robota, podczas gdy japońscy byli bardziej otwarci na kontakt fizyczny i „osobowość” robota. Takie obserwacje pokazują, że projektowanie uniwersalnych zachowań robota może być ryzykowne – lepszym podejściem jest możliwość personalizacji na poziomie kulturowym.

7. Podsumowanie i przyszłość

Interakcja fizyczna z robotami społecznymi, zwłaszcza w kontekście przekazywania przedmiotów, ujawnia wiele wyzwań technologicznych, społecznych i etycznych. Choć na pierwszy rzut oka może się wydawać, że podanie kubka czy książki to prosta czynność, dla robota wymaga to przetwarzania sygnałów z wielu kanałów jednocześnie – rozpoznania przedmiotu, zrozumienia intencji użytkownika, oceny bezpieczeństwa działania oraz dostosowania formy przekazania do kontekstu i osoby.

Z dotychczasowych badań i wdrożeń wynika, że kluczowe znaczenie mają: przewidywalność działania robota, jasna sygnalizacja zamiarów oraz zdolność reagowania na sygnały potwierdzające ze strony użytkownika. Tylko wtedy można mówić o bezpiecznej, naturalnej i akceptowalnej społecznie współpracy.

„Idealna” strategia komunikacji z robotem społecznym powinna być:

- Multimodalna – łączyć głos, gesty, wzrok i dotyk, dając użytkownikowi elastyczność wyboru,

- Kontekstowa – uwzględniać sytuację, otoczenie i wcześniejsze interakcje,

- Zindywidualizowana – dostosowywać się do preferencji konkretnego użytkownika, także kulturowych,

- Bezpieczna i przewidywalna – unikać gwałtownych ruchów, naruszania przestrzeni osobistej i wymuszać potwierdzenia przed działaniem.

Patrząc w przyszłość, coraz większą rolę odgrywać będzie integracja zaawansowanej sztucznej inteligencji. Modele językowe, systemy rozpoznawania emocji czy uczenie przez obserwację pozwolą robotom lepiej rozumieć ludzi i adaptować się do ich zachowań. Już dziś testuje się systemy, w których robot nie tylko wykonuje polecenia, ale też sam uczy się preferowanego stylu komunikacji konkretnej osoby.

Rozwój HRI zmierza więc w stronę bardziej płynnych, naturalnych interakcji, w których robot nie będzie tylko wykonawcą, ale aktywnym i świadomym uczestnikiem codziennych czynności. Przekazywanie przedmiotów to dobry punkt wyjścia – bo choć z pozoru niewielki, ma ogromny wpływ na poczucie bliskości i zaufania między człowiekiem a maszyną.

Bibliografia

-

Care-O-bot®. (n.d.). Fraunhofer IPA – Care-O-bot 4. https://www.care-o-bot.de/en/care-o-bot-4.html

-

Furhat Robotics. (n.d.). Furhat Technology Overview. https://furhatrobotics.com/technology/

-

MediaPipe. (n.d.). Pose Landmarker. Google Developers. https://developers.google.com/mediapipe/solutions/vision/pose_landmarker

-

OpenPose. (n.d.). OpenPose: Real-time multi-person keypoint detection library for body, face, and hands estimation. Carnegie Mellon University. https://github.com/CMU-Perceptual-Computing-Lab/openpose

-

PAL Robotics. (n.d.). TIAGo robot platform. https://pal-robotics.com/robot/tiago

-

SoftBank Robotics. (n.d.). Pepper – The Humanoid Robot. https://www.softbankrobotics.com/emea/en/pepper

-

Toyota Global. (2019, November). Human Support Robot (HSR) — Partner Robot. https://global.toyota/en/newsroom/corporate/28912712.html

[…] poprzednim artykule skupiliśmy się na seks robotach w ogólności, a także na najpopularniejszej formie tego […]