Home » Posts tagged 'zaufanie'

Tag Archives: zaufanie

Budowanie zaufania do cyfrowych lekarzy – jak projektować systemy AI wspomagające diagnozę medyczną, aby użytkownicy mieli do nich większe zaufanie

Współczesna medycyna znajduje się u progu przełomu, którego siłą napędową jest dynamiczny rozwój sztucznej inteligencji (AI). Systemy AI coraz śmielej wkraczają w obszar opieki zdrowotnej – wspierając proces diagnostyczny, umożliwiając personalizację terapii oraz usprawniając funkcjonowanie całego systemu ochrony zdrowia. Liczba zatwierdzonych do użytku klinicznego urządzeń medycznych opartych na AI systematycznie rośnie – do sierpnia 2024 roku Amerykańska Agencja ds. Żywności i Leków (FDA) wydała zgodę na wdrożenie 950 takich rozwiązań.

Sztuczna inteligencja, której możesz zaufać – wyjaśnialność decyzji w praktyce biznesowej

W erze dynamicznego rozwoju sztucznej inteligencji coraz więcej firm sięga po algorytmy do podejmowania decyzji finansowych, analizy ryzyka czy obsługi klientów. Szczególnie w sektorze bankowym i transakcyjnym AI zaczyna odgrywać kluczową rolę w procesach, które jeszcze niedawno były zarezerwowane wyłącznie dla ludzi. Jednak wraz z rosnącym wpływem maszyn na decyzje o kredytach, inwestycjach czy wykrywaniu nadużyć, pojawia się fundamentalne pytanie: czy możemy zaufać decyzjom podejmowanym przez algorytmy, których działania często nie rozumiemy?

Zaufanie do AI nie powstaje samo – trzeba je aktywnie budować. Kluczowym elementem tego procesu jest wyjaśnialność decyzji podejmowanych przez systemy – czyli zdolność do zrozumienia, dlaczego algorytm podjął taką, a nie inną decyzję. W tym wpisie przyjrzymy się, jak budować transparentne, zrozumiałe i etyczne systemy AI w biznesie, ze szczególnym uwzględnieniem sektora bankowego i finansowego.

Granica między realizmem a dziwacznością w robotach i systemach AI – ponowna analiza teorii „Uncanny Valley”

Zjawisko „uncanny valley” odnosi się do dyskomfortu lub niepokoju, jaki odczuwają ludzie w reakcji na obiekty, które są niemal – ale nie do końca – ludzkie w wyglądzie lub zachowaniu. Termin ten został wprowadzony przez japońskiego badacza Masahiro Moriego w latach 70. XX wieku, opisując wykres reakcji emocjonalnej na różne poziomy podobieństwa do człowieka. Im bardziej robot, animacja czy sztuczna inteligencja przypomina człowieka, tym bardziej jest nam przyjazna – aż do momentu, gdy staje się zbyt podobna, ale nadal nienaturalna. Wtedy reakcja staje się odwrotna – pojawia się niepokój, strach lub obrzydzenie. Efekt ten ma istotne znaczenie w robotyce, animacji komputerowej i projektowaniu interfejsów, ponieważ pokazuje, jak delikatna granica oddziela to, co realistyczne i akceptowalne, od tego, co wywołuje instynktowny lęk.

Cyfrowa nekromancja w polskim radiu

Dnia 22.10.2024 słuchacze Off Radio Kraków mieli przyjemność posłuchać wywiadu z wybitną polską poetką na temat literackiej Nagrody Nobla 2024. Nie byłoby w tym nic dziwnego, gdyby nie fakt, że dziennikarka nie istnieje, a respondentka nie żyje już od ponad dekady. (więcej…)

Revenge porn – jak technologia i prawo mogą chronić ofiary cyfrowej przemocy intymnej

Revenge porn – jak technologia i prawo mogą chronić ofiary cyfrowej przemocy intymnej

W erze wszechobecnych smartfonów i mediów społecznościowych, intymność stała się nie tylko łatwiejsza do uchwycenia, ale i niebezpiecznie podatna na wykorzystanie. Zjawisko znane potocznie jako „revenge porn”, czyli publikowanie prywatnych, intymnych zdjęć lub filmów bez zgody osoby na nich przedstawionej, jest brutalną formą cyfrowej przemocy, która niszczy życie, kariery i poczucie bezpieczeństwa ofiar. Dodatkowo, wraz z coraz bardziej zaawansowanymi i szeroko dostępnymi narzędziami sztucznej inteligencji, pojawiają się kolejne, niespotykane wcześniej zagrożenia, zaś samo ryzyko padnięcia ofiarą tego przestępstwa jest większe niż kiedykolwiek. Ten wpis zagłębia się w istotę problemu, jego historię i kontekst społeczny. Analizujemy również istniejące i potencjalne mechanizmy – zarówno instytucjonalne, jak i technologiczne – mające na celu identyfikację, ograniczanie oraz przeciwdziałanie tej formie nadużycia, a także wskazujemy, jak realnie wspierać osoby dotknięte tą traumą.

Identyfikacja i oznaczanie grafiki generowanej przez AI – od znaków wodnych po zaawansowane algorytmy głębokiego uczenia.

Czy to jeszcze człowiek, czy już maszyna? Po co oznaczać obrazy generowane przez AI i jak działa ich wykrywanie?

W dobie generatywnej sztucznej inteligencji granica między grafiką tworzoną przez człowieka a obrazem wygenerowanym przez algorytmy coraz bardziej się zaciera. W odpowiedzi na to wyzwanie powstaje wiele technologii mających na celu oznaczanie i wykrywanie treści syntetycznych. Dlaczego to takie ważne? Bo chodzi o ochronę praw autorskich, walkę z dezinformacją i budowanie zaufania do cyfrowych treści.

Dlaczego oznaczanie obrazów AI jest potrzebne?

-

Ochrona przed wykorzystaniem do treningu bez zgody

Twórcy nie chcą, by ich prace były wykorzystywane do trenowania AI bez ich wiedzy. Oznaczenia pomagają zidentyfikować pochodzenie grafiki i chronić oryginalność dzieła.

-

Przeciwdziałanie manipulacjom

Obrazy mogą być przerabiane i wykorzystywane do dezinformacji, np. w deepfake’ach czy fałszywych wiadomościach. Informacja o ich sztucznym pochodzeniu zmniejsza ryzyko nadużyć.

-

Oznaczanie i określanie obrazów wygenerowanych przez AI

Wprowadzenie jednoznacznych oznaczeń (np. znaków wodnych) oraz technologii detekcji pozwala odbiorcom rozpoznać treści stworzone przez sztuczną inteligencję i podejmować świadome decyzje jako odbiorcy.

Benchmarking w analizie wielkich modeli językowych – wykrywanie biasów dotyczących płci, rasy, narodowości oraz preferencji seksualnych w generowanych treściach

Wielkie modele językowe (LLM – Large Language Models, takie jak GPT, Gemini czy Claude) odgrywają coraz większą rolę w komunikacji, edukacji, biznesie, badaniach naukowych i wielu innych obszarach życia codziennego. Algorytmy sztucznej inteligencji coraz częściej wpływają na decyzje mające realne konsekwencje społeczne. W związku z tym, oprócz oceny ich skuteczności i funkcjonalności, rośnie potrzeba analiza uprzedzeń (biasów) obecnych w generowanych treściach — dotyczących płci, rasy, narodowości oraz preferencji seksualnych.

Deepfake w pornografii — skala zjawiska, konsekwencje prawne i technologie przeciwdziałania

Rozwój sztucznej inteligencji otworzył przed ludzkością nowe możliwości, ale jednocześnie stworzył zagrożenia, których skali jeszcze do niedawna nikt nie przewidywał. Jednym z najbardziej niepokojących zjawisk jest wykorzystywanie technologii deepfake do tworzenia fałszywej pornografii z udziałem niczego nieświadomych osób, zarówno celebrytów, jak i zwykłych ludzi. Skala tego procederu rośnie lawinowo, a prawo w wielu krajach wciąż nie nadąża za tempem zmian.

(więcej…)

Wykorzystanie sztucznej inteligencji do egzekwowania prawa i monitorowania porządku publicznego w miastach przyszłości – czy algorytmy analizujące zachowania mieszkańców i autonomiczne systemy nadzoru poprawią bezpieczeństwo, czy staną się narzędziem masowej inwigilacji i ograniczania praw obywatelskich

Miasta przyszłości tworzymy dziś. Każde wdrożenie nowej technologii to decyzja o tym, jak będzie wyglądać przestrzeń jutra – coraz bardziej inteligentna, cyfrowo zintegrowana, sterowana algorytmami. Coraz głębiej ingerująca w naszą codzienność. Czy inteligentne systemy nadzoru naprawdę uczynią miasta bezpieczniejszymi? A może przekształcą je w cyfrowe panoptikony, w których prywatność stanie się luksusem, a wolność – iluzją?

Automatyczne systemy wykrywania oszustw finansowych, a granica między prewencją, a nadużyciem prywatności: Przegląd możliwości i społeczne konsekwencje

W dzisiejszym cyfrowym świecie, gdzie transakcje finansowe odbywają się z niespotykaną dotąd prędkością i w ogromnych ilościach, oszustwa finansowe stanowią poważne zagrożenie zarówno dla przedsiębiorstw, jak i indywidualnych konsumentów. Wraz z dynamicznym rozwojem technologii cyberprzestępcy nieustannie udoskonalają swoje techniki, przez co tradycyjne metody zabezpieczeń stają się niewystarczające. W odpowiedzi na to wyzwanie coraz większą rolę odgrywają automatyczne systemy wykrywania oszustw finansowych, wykorzystujące sztuczną inteligencję (AI) i inne zaawansowane technologie. Niniejszy artykuł ma na celu przedstawienie możliwości tych systemów oraz analizę cienkiej granicy między skuteczną prewencją oszustw a nadużyciem prywatności, a także omówienie społecznych konsekwencji ich wdrożenia.

Technologiczne i socjotechniczne metody budowania zaufania w kontekście systemów sztucznej inteligencji – poziomy zaufania wobec AI

Sztuczna inteligencja (AI) odgrywa coraz większą rolę w naszym codziennym życiu, wpływając na decyzje biznesowe, systemy opieki zdrowotnej, edukację i administrację publiczną. Jednak jednym z kluczowych wyzwań związanych z implementacją AI jest budowanie i utrzymywanie zaufania użytkowników wobec tych systemów. W artykule opiszę technologiczne i socjotechniczne metody budowania zaufania oraz omówię różne sytuacje w których owo zaufanie zostało nadszarpnięte wraz z obawami i nadziejami jakie ludzie mogą mieć wobec AI.

Czy jako społeczeństwo potrzebujemy autonomicznego (automatycznego) transportu? – Wyzwania etyczne i problemy społeczne.

W ostatnich latach temat autonomicznego transportu zyskał na znaczeniu, stając się jednym z kluczowych zagadnień w dyskusjach o przyszłości mobilności. Wraz z postępem technologicznym, pojazdy autonomiczne obiecują zwiększenie efektywności transportu, bezpieczeństwa na drogach oraz dostępności dla osób z ograniczeniami mobilności. Niemniej jednak, wprowadzenie tej technologii rodzi szereg wyzwań etycznych i społecznych, które wymagają krytycznej analizy. Jednak czy autonomiczny transport rzeczywiście przyczyni się do poprawy bezpieczeństwa na drogach, eliminując błędy ludzkie, czy może sam wprowadzi nowe rodzaje zagrożeń?

Not black box but black hole. Technologiczna osobliwość i punkt odcięcia. Jeśli AI zacznie się samoprogramować to czy utracimy nad nią kontrolę? Przypadki kiedy przestajemy rozumieć to co dzieje się wewnątrz systemów AI.

Wzrost znaczenia sztucznej inteligencji w codziennym życiu rodzi przed tego typu wyzwania i problemy, które nie były tak głośne i palące w fazie badań akademickich nad nimi. Tymczasem spodziewana wielowymiarowość zadań przejmowanych przez AI i dziedzin życia, w których będzie się pojawiać zmusza do zadania pytania o takie problemy jak rozumienie ich działania, możliwości samoprogramowania się, oraz przede wszystkim o perspektywie utraty kontroli nad systemami AI. Czy to możliwe, że to właśnie poziom zaawansowania sztucznej inteligencji i jej skomplikowanie paradoksalnie sprawi, że brak dostatecznej kontroli nad nią zmusi nas do rezygnacji z przełomów, które obiecujemy sobie po tej technologii?

Robot sharing czy robot owning. Przyszłość branży robotycznej – czy będziemy kupować roboty do prac domowych, a do seksu wypożyczać. Perspektywa futurologiczna.

Wstęp

W dobie coraz bardziej zaawansowanej technologii robotyka staje się kluczowym elementem naszej codzienności. Już teraz roboty uczestniczą w wielu aspektach życia społecznego i zawodowego, a przewidywania na przyszłość są jeszcze bardziej rewolucyjne. Rozwój technologii robotycznych przynosi jednak nie tylko obietnice lepszego jutra, ale i wyzwania związane z integracją robotów w społeczeństwie. Czy przyszłość należy do modelu posiadania indywidualnych robotów, czy też kierujemy się ku modelowi współdzielenia tych zaawansowanych maszyn? Z jakimi wyzwaniami i konsekwencjami wiąże się każde z tych rozwiązań? (więcej…)

Etyka robotów domowych: Dylematy moralne i społeczne

Współczesne gospodarstwa domowe coraz częściej korzystają z zaawansowanych technologii, w tym robotów, które służą nie tylko do rozrywki, ale przede wszystkim do usprawniania codziennych obowiązków. Roboty sprzątające, pomagające w kuchni czy opiekujące się osobami starszymi, stają się nieodłącznym elementem naszego życia. Robotyka domowa, choć na pierwszy rzut oka może wydawać się tylko kolejnym krokiem w rozwoju technologii, to w rzeczywistości przekształca naszą codzienność, wprowadzając nowe wzorce interakcji między człowiekiem a maszyną. Roboty takie jak Roomba czy roboty opiekuńcze już teraz odgrywają kluczowe role w wielu gospodarstwach domowych, jednak ich wszechobecność stawia przed nami nowe wyzwania etyczne i społeczne. (więcej…)

Miłość i sex: roboty, love chatboty, wirtualne hologramy. Wpływ technologii na ludzką intymność.

Czy byłbyś w stanie zakochać się w hologramie, nawiązać głęboką więź z androidem, lub po prostu wymieniać czułe słowa z chatbotem? Rozwój technologii radykalnie wpływa na nasze rozumienie codzienności, zacierając granice między światem rzeczywistym i wirtualnym. Zaczynamy coraz częściej przenosić coraz więcej obszarów naszego życia do sfery cyfrowej, gdzie codzienna rozmowa ze sztuczną inteligencją staje się normą. Czy to oznacza, że jesteśmy na skraju nowej ery, w której technologia przekształci tradycyjne pojęcia związane z ludzką intymnością? Jaki wpływ mają chatboty na ludzkie postrzeganie związków i relacji? Czy roboty mogą zaspokoić nasze emocjonalne i fizyczne potrzeby?

Twój wirtualny partner w biznesie – czy systemy SI i data science wzbudzają zaufanie, co sprawi by zaufanie było jeszcze większe. Analiza przypadków

źródło: https://micro.ai/company/partnerships

We live in a society that functions based on a high degree of trust. We have a lot of systems that require trustworthiness, and most of them we don’t even think about day to day ~ Yisong Yue, California Institute of Technology

Kluczem do sukcesu w budowaniu skutecznych oraz długotrwałych relacji biznesowych jest konsekwentne działanie zgodnie z przyjętymi zasadami etyki, dostarczając wysokiej jakości wartość w trakcie rzetelnej pracy na rzecz wspólnie wyznaczonych celów. Rozważając kwestię zaufania między człowiekiem a systemami Sztucznej Inteligencji (SI), należy w pierwszej kolejności zastanowić się jak wygląda proces budowania zaufania między ludźmi. W relacjach biznesowych istnieje wiele czynników, które mają kluczowe znaczenie na drodze do sukcesu. Istotne jest nawiązywanie i utrzymywanie dobrych relacji z klientami, dostawcami, partnerami biznesowymi oraz pracownikami. Ponadto, w relacjach biznesowych ważne jest, aby partnerzy biznesowi byli kompetentni, działali w imię wspólnego dobra z odpowiednim nastawieniem, celem sprostania wyzwaniom związanym z prowadzeniem biznesu. Kluczem do skutecznej i owocnej relacji biznesowej jest budowanie jej na fundamencie wzajemnego zaufania, biorąc pod uwagę następujące czynniki:

- Działanie zgodnie z zasadami etyki

- Wywiązywanie się z obowiązków

- Otwarta i rzeczowa komunikacja

- Płynna współpraca i zrozumienie

- Jakość

- Lojalność

- Innowacyjność

- Obiektywność

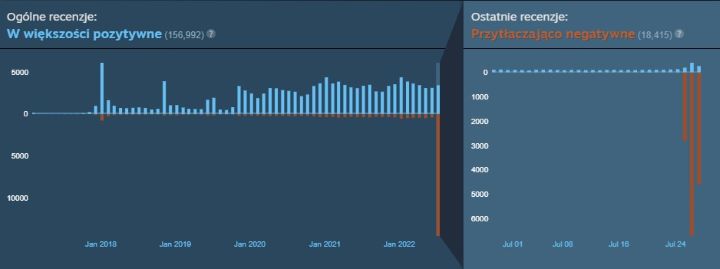

Bomb reviewing – jak użytkownicy, trolle i skrypty mogą przyczyniać się do nieuczciwej konkurencji. Analiza zjawiska.

Jak budować zaufanie w systemach opartych na sztucznej inteligencji. Kwestia wyjaśniania i analiza porównawcza człowiek/maszyna.

O sztucznej inteligencji słyszał już niemal każdy, ale stosunkowo niewielka część naszego społeczeństwa zetknęła się z tą innowacją bezpośrednio. Nie wpływa to jednak na nasze spore oczekiwania wobec sztucznej inteligencji. Wierzymy w to, że może przyczynić się do pozytywnych zmian na płaszczyznach społecznej i gospodarczej. Wykorzystanie całkowitego potencjału sztucznej inteligencji wiąże się ze stawieniem czoła etycznym wyzwaniom związanym z coraz powszechniejszym wykorzystaniem AI. Godna zaufania sztuczna inteligencja może przynieść wiele korzyści takich jak na przykład lepsza opieka zdrowotna, bezpieczniejszy i bardziej ekologiczny transport, wydajniejsza produkcja czy też tańsze i przede wszystkim bardziej zrównoważone źródła energii.

(więcej…)

Sztuczna kreatywność – przegląd rozwiązań z zakresu SI, które tworzą sztukę. Możliwości i ograniczenia.

Wedle słownika języka polskiego definicja słowa kreatywny brzmi:

1. zdolny do tworzenia czegoś nowego, oryginalnego; twórczy, pomysłowy;

2. mający na celu tworzenie czegoś nowego, oryginalnego, np. kreatywna dyskusja, decyzja

Istnieje wiele sformułowań, którymi można określić kreatywność – nieprzewidywalna, niewytłumaczalna, w wybitnych przypadkach wręcz niemożliwa. I chociaż znamy różnicę pomiędzy lewą, a prawą półkulą mózgu, bardzo często nie jesteśmy w stanie wskazać składowych, które są składnikami np. procesu twórczego. Z drugiej strony stawiam sztuczną inteligencję. Programy napisane z jej pomocą, implementujące ją, są projektowane do bycia logicznymi oraz systematycznymi. W ich przypadku nie możemy mówić o impulsywnych czy spontanicznych działaniach (takich jak np. ludzka kreatywność). Na ten moment programy AI są tworzone do przetwarzania informacji (w podany sposób) aby w wyniku tego uzyskiwać określony rezultat. Podane im instrukcje nie podlegają w żadnym stopniu krytycznej ocenie, zatem wykonywane przez nie akcję są powtarzalne oraz przewidywalne.

Obserwując to porównanie z zewnątrz natychmiast nasuwa nam się wniosek, że kreatywność ludzka oraz sztuczna inteligencja są fundamentalnie różne, a porównywanie ich nie jest w żadnym stopniu możliwe, ale czy na pewno? (więcej…)

[…] poprzednim artykule skupiliśmy się na seks robotach w ogólności, a także na najpopularniejszej formie tego […]