Wraz z rozwojem technologii, coraz więcej państw zaczyna wykorzystywać sztuczną inteligencję do przetwarzania obrazów z systemów monitoringu CCTV (Closed-Circuit Television) w celu zapewnienia bezpieczeństwa publicznego. Jednak zastosowanie tych narzędzi i technologii widzenia komputerowego stawia pytania dotyczące prywatności jednostek obserwowanych. W tym artykule przyjrzymy się bliżej różnym metodom nadzoru i inwigilacji przy wykorzystaniu narzędzi AI w różnych państwach. Wspomnimy też o ich wpływie na nasze prawa do prywatności.

Wstęp

Kontrowersje dotyczące stosowania narzędzi sztucznej inteligencji (AI) w nadzorze i inwigilacji wzbudzają istotne pytania dotyczące równowagi między zapewnianiem bezpieczeństwa publicznego a ochroną prywatności jednostek obserwowanych. W dzisiejszym świecie, gdzie technologia staje się coraz bardziej zaawansowana, systemy monitoringu, oparte na widzeniu komputerowym i analizie danych, nabierają nowego wymiaru. Z jednej strony, narzędzia AI mogą dostarczać cenne informacje, umożliwiając wykrywanie zagrożeń, rozwiązywanie przestępstw i poprawę bezpieczeństwa publicznego. Z drugiej strony istnieje obawa, że ich stosowanie może naruszać prywatność obywateli i prowadzić do nadużyć ze strony władz lub prywatnych podmiotów.

W przypadku systemów monitoringu opartych na narzędziach AI, powstaje wiele pytań dotyczących etyki i odpowiedzialności. Czy obywatele są świadomi, że są obserwowani? Czy istnieje jasne prawo regulujące zakres i sposób wykorzystania zebranych danych? Jakie są skutki dla jednostek obserwowanych, gdy ich dane są gromadzone, analizowane i przechowywane? Te pytania stają się szczególnie istotne w kontekście różnic kulturowych i prawnych między państwami, które mogą prowadzić do różnych podejść do nadzoru i inwigilacji.

Ważne jest, aby wprowadzić odpowiednie regulacje i mechanizmy kontroli, które zapewnią transparentność i zgodność z zasadami praworządności. Istnieje potrzeba równoważenia potrzeb bezpieczeństwa publicznego z prawem jednostek obserwowanych do prywatności. Tego rodzaju regulacje powinny uwzględniać zasady proporcjonalności, minimalizacji danych oraz ochrony praw jednostek. Ponadto, powinny istnieć instytucje nadzoru, które monitorują i egzekwują przestrzeganie tych regulacji, aby uniknąć nadużyć i naruszeń praw obywateli.

W celu dokładniejszego zrozumienia wpływu narzędzi AI na nadzór i inwigilację, warto przyjrzeć się praktykom stosowanym w różnych państwach. Każde państwo może mieć odmienne podejście do nadzoru i inwigilacji, wynikające z kontekstu społecznego, politycznego i prawno-etycznego. Analiza tych praktyk może dostarczyć cennych wskazówek i wniosków dotyczących skutków dla prywatności i społeczeństwa jako całości.

W tym artykule zaprezentuję przykłady praktyk nadzoru i inwigilacji przy wykorzystaniu narzędzi AI w różnych państwach. Przyjrzymy się zarówno krajom, które wprowadziły surowe regulacje i nadzór, jak i tym, które przyjęły bardziej liberalne podejście. Analizując te przypadki, będziemy mogli ocenić skutki oraz zidentyfikować wyzwania i możliwości związane z ochroną prywatności jednostek obserwowanych. Przeanalizujemy również podejmowane przez społeczeństwo i ekspertów działania mające na celu znalezienie równowagi między bezpieczeństwem a prawem do prywatności.

Kontynuując dalsze rozważania na temat CCTV, widzenia komputerowego, prawa do prywatności i narzędzi AI w różnych państwach, będziemy w stanie lepiej zrozumieć wyzwania i możliwości związane z tym obszarem. Pragnę podkreślić, że omawiane tematy nie mają na celu jednoznacznego rozstrzygnięcia, ale raczej stworzenia przestrzeni do refleksji i dyskusji nad równowagą między bezpieczeństwem a prawem do prywatności.

Metody nadzoru i inwigilacji

W różnych państwach istnieją różne metody nadzoru i inwigilacji przy wykorzystaniu narzędzi AI. Na przykład, w niektórych krajach systemy monitoringu CCTV są zintegrowane z bazami danych publicznych, umożliwiając identyfikację osób na podstawie zapisów wideo. Inne państwa stosują zaawansowane algorytmy analizujące zachowanie jednostek obserwowanych w celu wykrywania podejrzanych aktywności. Przyjrzyjmy się teraz sytuacji w Chinach, USA i Polsce.

Chiny

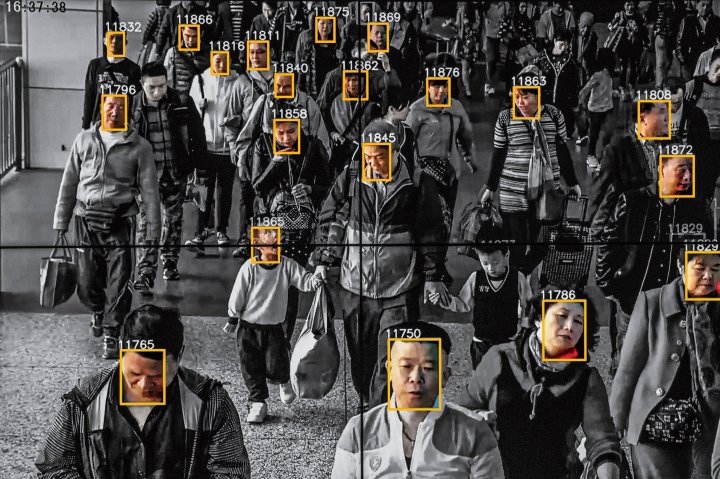

Chiny są znane z powszechnego i mocno rozwiniętego systemu nadzoru. Według estymacji, w samych Chinach jest ponad 600 milionów kamer bezpieczeństwa [3]. Jednym z najbardziej znanym przykładów jest system rozpoznawania twarzy, który jest powszechnie stosowany w chińskich miastach. W ramach tego systemu kamery CCTV wyposażone w technologię AI analizują i identyfikują osoby na podstawie ich cech twarzy. W połączeniu z ogromnymi bazami danych, władze chińskie mogą monitorować i śledzić obywateli w czasie rzeczywistym.

Ponadto, w Chinach rozwijane są systemy oceny społecznej, które wykorzystują AI do analizy i oceny zachowań obywateli. Systemy te opierają się na zbieraniu i analizowaniu danych z różnych źródeł, takich jak monitorowanie zachowań w przestrzeni publicznej, aktywności w mediach społecznościowych czy oceny wiarygodności kredytowej. Na podstawie tych danych obywatele otrzymują punktację, która ma wpływ na ich dostęp do różnych usług i przywilejów.

Stany Zjednoczone

W Stanach Zjednoczonych również stosuje się metody nadzoru oparte na narzędziach AI, choć w nieco innej skali i kontekście. System rozpoznawania twarzy jest jednym z elementów całej układanki, gdyż skupia się również na przykład na programach bazujących na statystykach, by wykrywać osoby „potencjalnie niebezpieczne”. System ten jest wykorzystywany przez niektóre agencje rządowe i służby policyjne w kilku stanach.

Innym z przykładów jest analiza treści w mediach społecznościowych przy wykorzystaniu sztucznej inteligencji. Wiele agencji rządowych i służb odpowiedzialnych za bezpieczeństwo korzysta z zaawansowanych algorytmów AI, które automatycznie przeglądają, analizują i identyfikują treści podejrzane lub związane z zagrożeniem dla bezpieczeństwa publicznego. Mogą to być wpisy, komentarze, zdjęcia lub filmy, które zawierają wzmianki o terroryzmie, przestępczości zorganizowanej lub innym niebezpiecznym działaniu.

Dzięki temu narzędziu służby mogą szybko i skutecznie przesiewać ogromne ilości danych, co pozwala im na wczesne wykrywanie potencjalnych zagrożeń i podejmowanie odpowiednich działań. Systemy te są ważnym elementem działań antyterrorystycznych i służą ochronie bezpieczeństwa publicznego w kraju. Jednakże, ze względu na potencjalne zagrożenie dla prywatności, istnieje konieczność odpowiedniego regulowania i monitorowania takich działań, aby zapewnić równowagę między bezpieczeństwem a ochroną praw jednostki.

Polska

W Polsce również obserwuje się rozwój technologii nadzoru opartych na narzędziach AI. Kamery CCTV wyposażone w funkcje rozpoznawania twarzy są coraz powszechniejsze, szczególnie w większych miastach. Systemy te mają na celu zwiększenie bezpieczeństwa publicznego i wsparcie działań służb odpowiedzialnych za utrzymanie porządku.

Ponadto, rozwijane są systemy monitorowania treści w internecie przy wykorzystaniu technologii AI. Algorytmy są używane do wykrywania nielegalnych treści, takich jak treści pornograficzne czy propagujące przemoc, co ma na celu ochronę użytkowników i zwalczanie przestępstw internetowych.

W przypadku każdego kraju istnieją oczywiście pewne różnice w zakresie regulacji i zasad dotyczących nadzoru i inwigilacji. Ważne jest, aby zapewnić równowagę między bezpieczeństwem publicznym a poszanowaniem prywatności obywateli, co często jest przedmiotem debat i dyskusji na poziomie legislacyjnym.

Warto wymienić tutaj również dość unikalny „eksperyment” przeprowadzany przez firmę Żabka. Firma wprowadziła na rynek koncepcję sklepów Żabka Nano, które są monitorowane za pomocą systemów CCTV opartych na sztucznej inteligencji.

Polemika nad podejmowanym problemem

Kontrowersje dotyczące stosowania narzędzi AI w nadzorze i inwigilacji dotyczą równowagi między zapewnianiem bezpieczeństwa publicznego a ochroną prywatności jednostek obserwowanych. W niektórych przypadkach systemy monitoringu są wykorzystywane do nadzoru obywateli bez ich zgody lub bez odpowiedniego nadzoru prawno-etycznego. Dlatego konieczne jest wprowadzenie odpowiednich regulacji i mechanizmów kontroli, aby zapewnić, że narzędzia AI są stosowane w sposób przejrzysty i zgodny z prawem.

Literatura

W trakcie badań nad tym tematem skorzystałem z następujących źródeł:

- China’s 'sharp eyes’ offer chance to take surveillance industry global, https://asia.nikkei.com/Business/China-tech/China-s-sharp-eyes-offer-chance-to-take-surveillance-industry-global

- Santosh, K., Gaur, L. (2021). Privacy, Security, and Ethical Issues. In: Artificial Intelligence and Machine Learning in Public Healthcare. SpringerBriefs in Applied Sciences and Technology(). Springer, Singapore. https://doi.org/10.1007/978-981-16-6768-8_8

- Ich życie śledzi 600 mln kamer. Za złe zachowanie trafia się na „ekran wstydu”, https://noizz.pl/spoleczenstwo/ich-zycie-sledzi-600-mln-kamer-za-zle-zachowanie-trafia-sie-na-ekran-wstydu/mtfwb9g

- Bezobsługowa Żabka. Zabierasz produkty i wychodzisz, https://biznes.lovekrakow.pl/aktualnosci/bezobslugowa-zabka-zabierasz-produkty-i-wychodzisz_43071.html

- Gerke S, Minssen T, Cohen G (2020) Ethical and legal challenges of artificial intelligence-driven healthcare. Artif Intell Healthc 295–336.https://doi.org/10.1016/B978-0-12-818438-7.00012-5

- Inwigilacja, https://pl.wikipedia.org/wiki/Inwigilacja

Konkluzja

Stosowanie narzędzi AI w systemach monitoringu i nadzoru niesie za sobą zarówno korzyści, jak i wyzwania związane z prywatnością. Aby zapewnić równowagę między bezpieczeństwem publicznym a prawami jednostek obserwowanych, niezbędne są odpowiednie regulacje i nadzór prawno-etyczny. Kluczowe jest również uwzględnienie różnic kulturowych i prawnych między poszczególnymi państwami, aby uniknąć nadużyć i naruszeń prywatności.

Czytaj dalej

Przykłady praktyk nadzoru i inwigilacji przy wykorzystaniu narzędzi AI w różnych państwach oraz analiza ich skutków dla prywatności jednostek obserwowanych są tylko częścią obszernego zagadnienia. Zapraszam do dalszej lektury, aby zgłębić temat i lepiej zrozumieć wpływ tych praktyk na nasze społeczeństwo.