Wojny na miecze ustąpiły miejsca wojnom na karabiny, te z kolei bombom – ale czy nadchodzi era wojen informacyjnych, w których bronią są obrazy i dźwięki, a nie proch i stal? Technologia rozwija się nie tylko w codziennym użytku, lecz również w obszarze konfliktów zbrojnych.

W tym wpisie nie skupimy się na tradycyjnym sprzęcie wojskowym, lecz na nowym, coraz powszechniej wykorzystywanym narzędziu prowadzenia wojny – technologii DeepFake i jej zastosowaniu w dezinformacji oraz propagandzie w kontekście wojny hybrydowej.

Dezinformacja i skutki psychologiczne

Złe wiadomości mają realny wpływ na naszą psychikę. Każda negatywna informacja wywołuje emocje – od niepokoju, przez złość, po strach. A człowiekiem zastraszonym łatwiej manipulować.

Ten mechanizm bywa wykorzystywany nie tylko w polityce wewnętrznej (np. kampaniach wyborczych), ale także podczas wojen. Osłabione morale przeciwnika to ogromna przewaga strategiczna.

DeepFake jako forma dezinformacji może prowadzić do paniki, zamętu, utraty zaufania społecznego, a nawet destabilizacji państw. I właśnie z tego powodu coraz częściej pojawia się w arsenale wojny hybrydowej.

DeepFake — nie zawsze zły

Warto zauważyć, że deepfake nie musi mieć wyłącznie negatywnych zastosowań. Przykładem jest automatyczne tłumaczenie wideo z dopasowaniem ruchu ust do nowego języka. Takie rozwiązania mogą ułatwić edukację czy komunikację międzykulturową.

Mimo to, każdorazowe użycie deepfake’ów niesie ze sobą ryzyko etyczne – zwłaszcza jeśli nagrania powstają bez zgody przedstawionych osób. Nawet dobre intencje mogą prowadzić do nadużyć.

DeepFake a etyka „sprawiedliwej wojny”

Z perspektywy etyki just war theory (etyki „sprawiedliwej wojny”), dezinformacja w postaci zmanipulowanych nagrań jest działaniem problematycznym. Wojna powinna być prowadzona proporcjonalnie, z poszanowaniem godności człowieka oraz prawdy.

Deepfake łamie te zasady — manipuluje opinią publiczną, tworzy iluzję i zaburza racjonalny osąd. Jednocześnie daje ogromną przewagę strategiczną, co czyni go narzędziem pokusznym, choć moralnie wątpliwym.

Przykład z Ukrainy

W 2022 roku, po inwazji Rosji na Ukrainę, w mediach społecznościowych pojawiło się fałszywe nagranie, na którym prezydent Zełenski rzekomo nawołuje do kapitulacji.

Był to deepfake – cyfrowa manipulacja nakładająca twarz i głos Zełenskiego na ciało aktora. Celem było podważenie morale i wywołanie chaosu wśród Ukraińców. To przykład realnego użycia deepfake’a jako broni psychologicznej i informacyjnej.

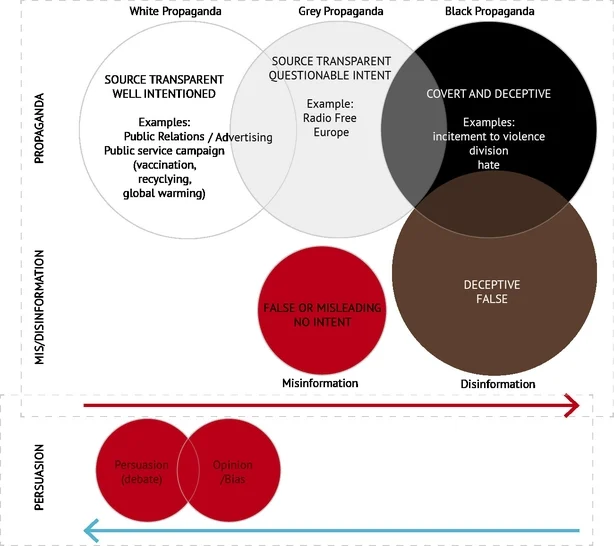

Propaganda – klasyfikacja i znaczenie

W kontekście wojny hybrydowej pojęcie propagandy nabiera nowego znaczenia. Choć często rozumiana pejoratywnie, w naukach społecznych ma bardziej neutralne ujęcie.

Neutralna definicja:

Propaganda to celowe i systematyczne kształtowanie percepcji, emocji i zachowań jednostek lub grup w celu osiągnięcia konkretnego celu (Nelson, 1996).

Rodzaje propagandy:

-

Biała – nadawca jest znany, informacje są w dużej mierze prawdziwe.

-

Szara – niejasne źródło, informacje częściowo prawdziwe lub niepełne.

-

Czarna – źródło ukryte lub fałszywe, treści wprowadzają w błąd.

To właśnie czarna propaganda, do której zaliczamy deepfake, jest najtrudniejsza do wykrycia i najbardziej niebezpieczna w czasie konfliktów.

Propaganda wojskowa i deepfake

W ujęciu militarnym propaganda to każde działanie komunikacyjne wspierające cele strategiczne państwa. Deepfake wpisuje się w tę definicję – stając się narzędziem nowoczesnej wojny psychologicznej.

Jako przykład można przywołać słynny eksperyment z Barackiem Obamą, któremu przypisano słowa, których nigdy nie wypowiedział. Deepfake może wprowadzać chaos, podważać autorytety i wywoływać niepokoje społeczne – szczególnie w czasach kryzysów.

Technologia ta, wspierana przez media społecznościowe i algorytmy rekomendacji, umożliwia błyskawiczne rozprzestrzenianie się zmanipulowanych treści do milionów odbiorców w czasie rzeczywistym.

Obrona przed deepfake – technologia i edukacja

Największym zagrożeniem nie jest sama technologia, lecz brak świadomości i krytycznego myślenia. Dlatego kluczowe są:

-

Rozwój algorytmów detekcji deepfake’ów,

-

Edukacja medialna i cyfrowa,

-

Promowanie czujności społecznej i weryfikowania informacji.

Tylko połączenie technologii i świadomości obywatelskiej może skutecznie przeciwdziałać nowoczesnej propagandzie.

Podsumowanie

Technologie takie jak deepfake stają się integralnym elementem współczesnych konfliktów – szczególnie w ramach wojny hybrydowej. Oferują ogromną siłę rażenia, nie przez zniszczenie fizyczne, lecz przez manipulację umysłami.

W obliczu takich zagrożeń, kluczowe staje się rozwijanie kompetencji społeczeństwa w zakresie krytycznego myślenia, umiejętności analizy informacji oraz rozpoznawania manipulacji – by przyszłe wojny nie były wygrywane tylko przez tych, którzy lepiej kłamią.

s

Źródła:

-

Chesney, R., & Citron, D. (2019). Deep fakes: A looming challenge for privacy, democracy, and national security. California Law Review, 107(6), 1753–1819.

-

Flattery, T., & Miller, C. B. (2024). Deepfakes and dishonesty. Philosophy & Technology, 37(4), 120. https://doi.org/10.1007/s13347-024-00812-1

-

Havlík, M. (2023). Deepfake as an advanced manipulative technique for spreading propaganda. Vojenské rozhledy, 32(1), 3–17. https://www.vojenskerozhledy.cz/en/kategorie-clanku/bezpecnostni-a-obranna-politika/19811-deepfake-jako-pokrocila-manipulativni-technika-k-sireni-propagandy

-

Nasu, H. (2022). Deepfake technology in the age of information warfare. Lieber Institute, West Point. https://lieber.westpoint.edu/deepfake-technology-age-information-warfare/