Czy młodzi dorośli ufają sztucznej inteligencji bez zastrzeżeń? Najnowsze badania pokazują, że choć aż 97% z nich korzysta z narzędzi AI, tylko niewielka część czuje się przygotowana do wykorzystywania ich w pracy zawodowej. Popularność technologii idzie więc w parze z rosnącą potrzebą krytycznego myślenia – bo w świecie, gdzie odpowiedzi generuje algorytm, zasada „zaufaj, ale sprawdź” staje się kluczową kompetencją cyfrowej dojrzałości.

Wyobraźmy sobie studenta, który późnym wieczorem siada do komputera, by dokończyć pracę zaliczeniową. Zamiast wertować książki czy artykuły, otwiera narzędzie AI i w kilka sekund otrzymuje zgrabnie sformułowany tekst. Wydaje się, że problem został rozwiązany, praca gotowa, czas na sen. Ale czy na pewno?

To prowadzi do pytania, które staje się coraz bardziej aktualne: czy ufamy temu, co podsuwa nam sztuczna inteligencja? Czy traktujemy jej odpowiedzi jako rzetelne źródło wiedzy, czy raczej jako inspirację, którą należy jeszcze zweryfikować?

AI stało się dziś codziennym narzędziem – wspiera nas w nauce, pomaga w pracy, a nawet towarzyszy w rozrywce. Generuje teksty, obrazy, podpowiada rozwiązania i oszczędza czas. Jednak wraz z tą wygodą pojawia się wyzwanie: jak zachować krytyczne spojrzenie i nie zatracić umiejętności samodzielnego myślenia w świecie, gdzie algorytmy podsuwają nam gotowe odpowiedzi?

Ilu młodych ludzi używa AI?

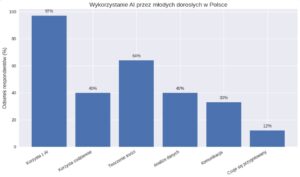

Raport „Generacja AI: młodzi Polacy na cyfrowym rynku pracy” przygotowany przez Microsoft i Talent Days pokazuje, że sztuczna inteligencja stała się niemal codziennością młodych dorosłych w Polsce. Aż 97% osób w wieku 18–35 lat korzysta z narzędzi AI, a dwóch na pięciu robi to codziennie, często wielokrotnie w ciągu dnia. Najczęściej wykorzystujemy je do tworzenia treści (64%), analizy danych (40%) czy komunikacji (33%).

Badanie „Generacja AI: młodzi Polacy na cyfrowym rynku pracy” zostało przeprowadzone w formie ankiety internetowej wśród osób w wieku 18-35 lat. Próba obejmowała kilka tysięcy respondentów, którzy odpowiadali na pytania dotyczące korzystania z narzędzi sztucznej inteligencji w życiu codziennym, edukacji i pracy. Ankieta była realizowana w ramach wydarzenia Talent Days – największych targów kariery dla młodych w Polsce – co pozwoliło dotrzeć do szerokiej grupy studentów i młodych profesjonalistów. Dzięki temu uzyskano przekrojowy obraz postaw wobec AI: od codziennego użycia po ocenę własnych kompetencji i poziomu przygotowania do pracy z tymi technologiami.

Jednak wysoka popularność nie oznacza pełnego zaufania. Z badań wynika, że tylko 12% młodych Polaków czuje się w pełni przygotowanych do wykorzystywania AI w pracy zawodowej. To pokazuje pewien rozdźwięk: z jednej strony traktujemy sztuczną inteligencję jako szybkie i wygodne narzędzie, z drugiej jednak, mamy świadomość jej ograniczeń i braku kompetencji, by korzystać z niej w sposób profesjonalny.

Co ciekawe, większość młodych uczy się obsługi AI samodzielnie – poprzez praktykę, media społecznościowe czy wymianę doświadczeń ze znajomymi. Formalna edukacja w tym zakresie wciąż pozostaje w tyle. To sprawia, że choć narzędzia AI są wszechobecne, krytyczne podejście do ich wyników dopiero się kształtuje.

Nawiązując do tytułu „Zaufaj, ale sprawdź”, łatwo zauważyć, że młodzi Polacy chętnie korzystają z AI, ale jednocześnie nie są jeszcze gotowi, by bezkrytycznie powierzyć jej odpowiedzialność za rzetelne informacje czy decyzje zawodowe. To właśnie w tym napięciu – między wygodą a ostrożnością – rodzi się nowa cyfrowa kompetencja: umiejętność krytycznej weryfikacji treści generowanych przez sztuczną inteligencję.

Szerszy kontekst społeczny

Sztuczna inteligencja w ostatnich latach stała się jednym z najważniejszych elementów cyfrowej codzienności młodych dorosłych – zarówno w Polsce, jak i w całej Europie. W edukacji AI pełni rolę „cichego asystenta”: pomaga w przygotowywaniu notatek, streszczeń, tłumaczeń czy rozwiązywaniu zadań. Studenci korzystają z niej, aby szybciej przyswoić materiał i zyskać przewagę w organizacji nauki. W pracy zawodowej młodzi profesjonaliści używają narzędzi AI do analizy danych, tworzenia raportów czy komunikacji – co pozwala im oszczędzać czas i zwiększać efektywność. W sferze rozrywki AI jest obecne w generowaniu obrazów, muzyki, pomysłów na treści w mediach społecznościowych czy nawet w grach, stając się częścią kultury młodzieżowej.

Porównując młodych dorosłych z innymi pokoleniami, widać wyraźną różnicę w poziomie zaufania i otwartości wobec nowych technologii. Badania OECD i Cisco wskazują, że osoby z pokolenia Z i młodszych millenialsów znacznie częściej korzystają z AI i traktują ją jako naturalne narzędzie codziennego życia. Starsze pokolenia – zwłaszcza osoby powyżej 45. roku życia – podchodzą do AI z większym dystansem, obawiając się jej wpływu na rynek pracy, prywatność czy wiarygodność informacji. Ta różnica pokoleniowa pokazuje, że dla młodych dorosłych AI jest czymś oczywistym, podczas gdy dla starszych bywa wciąż „nowinką technologiczną”, wymagającą oswojenia.

Wątek kulturowy jest tu szczególnie istotny. AI stało się częścią stylu życia młodych – podobnie jak smartfony dekadę temu. Korzystanie z narzędzi generatywnych nie jest już traktowane jako „technologiczny eksperyment”, lecz jako codzienna praktyka, wpisana w rytm nauki, pracy i rozrywki. Dla młodych dorosłych AI nie jest już tylko narzędziem, ale także elementem tożsamości cyfrowej – sposób na wyrażanie kreatywności, budowanie wizerunku w sieci i uczestnictwo w kulturze, która coraz częściej powstaje w dialogu człowieka z algorytmem.

Psychologia zaufania

Dlaczego tak łatwo ufamy technologiom? Psychologia podpowiada, że jednym z głównych mechanizmów jest heurystyka autorytetu – skłonność do uznawania informacji za prawdziwe, jeśli są podawane przez źródło postrzegane jako kompetentne, a cytując Lucyna Bakiera: „Heurystyka autorytetu polega na tym, że ludzie mają tendencję do uznawania informacji za prawdziwe, jeśli są podawane przez źródło postrzegane jako kompetentne lub posiadające władzę, nawet jeśli brak jest obiektywnych dowodów”. W przypadku AI rolę „autorytetu” pełni sam algorytm, który formułuje odpowiedzi w sposób spójny, logiczny i pozbawiony wahań. Jak zauważa literatura psychologiczna, ludzie często traktują takie komunikaty jako bardziej wiarygodne niż treści, które brzmią niepewnie.

Drugim mechanizmem jest efekt profesjonalnego języka. Ida Kurcz opisuje wpływ stylu wypowiedzi na odbiór treści: „Profesjonalny, uporządkowany język, pozbawiony emocjonalnych odwołań, budzi w odbiorcy poczucie rzetelności i kompetencji nadawcy, nawet jeśli treść nie jest w pełni zgodna z faktami” Badania nad psychologią zaufania wskazują, że styl wypowiedzi – uporządkowany, techniczny, pozbawiony emocji – budzi w odbiorcach poczucie rzetelności. Algorytmy AI generują teksty właśnie w takim tonie, co sprawia, że użytkownicy chętniej przyjmują je jako prawdziwe. Problem polega na tym, że „profesjonalny język” może maskować błędy i prowadzić do bezrefleksyjnego zaufania.

Ryzyko bezkrytycznego podejścia jest realne. Jak pokazują analizy z zakresu edukacji cyfrowej, młodzi dorośli często traktują treści generowane przez AI jako gotowe rozwiązania, nie podejmując wysiłku ich weryfikacji. To zjawisko wiąże się z tzw. heurystyką dostępności – skoro odpowiedź jest szybka i łatwo dostępna, uznajemy ją za wystarczającą. W efekcie powielane mogą być błędne informacje, a użytkownicy tracą zdolność samodzielnej oceny jakości źródeł.

Dlatego kluczową rolę odgrywa rozwijanie krytycznego myślenia. Instytut Badań Edukacyjnych podkreśla, że umiejętność oceny wiarygodności informacji i odporność na dezinformację to jedne z najważniejszych kompetencji w XXI wieku. Z kolei badania neuronaukowe wskazują, że krytyczne myślenie w erze AI polega na łączeniu kreatywności i refleksji etycznej z możliwościami technologii. Edukacja cyfrowa powinna więc nie tylko uczyć obsługi narzędzi, ale przede wszystkim rozwijać zdolność zadawania pytań, kwestionowania odpowiedzi i poszukiwania alternatywnych źródeł.

AI w praktyce

Edukacja – AI jako „cichy korepetytor”

W środowisku akademickim sztuczna inteligencja coraz częściej pełni rolę narzędzia wspierającego proces uczenia się. Studenci korzystają z niej do pisania prac zaliczeniowych, przygotowywania notatek czy streszczania obszernych materiałów. Zamiast spędzać godziny na samodzielnym opracowywaniu treści, mogą w kilka minut uzyskać syntetyczne podsumowanie książki czy artykułu naukowego. AI pomaga także w tłumaczeniach, generowaniu przykładów czy tworzeniu quizów do samodzielnej nauki.

Przykładowo, student psychologii może poprosić narzędzie AI o streszczenie rozdziału z podręcznika, a następnie wykorzystać je jako punkt wyjścia do własnych notatek. Z kolei osoby studiujące kierunki techniczne używają AI do rozwiązywania zadań matematycznych czy programistycznych, traktując je jako wsparcie w procesie rozumienia, a nie jako gotowe rozwiązanie. W tym kontekście AI staje się „cichym korepetytorem” – zawsze dostępnym, szybkim i elastycznym.

Praca – młodzi profesjonaliści i efektywność

Na rynku pracy młodzi profesjonaliści coraz częściej sięgają po narzędzia AI w codziennych obowiązkach. W obszarze analizy danych sztuczna inteligencja pozwala na szybkie przetwarzanie dużych zbiorów informacji i tworzenie raportów, które wcześniej wymagały wielu godzin pracy. Dzięki temu młodzi analitycy czy specjaliści HR mogą skupić się na interpretacji wyników, a nie na żmudnym liczeniu.

AI wspiera także komunikację – generuje szkice maili, propozycje odpowiedzi czy podsumowania spotkań. W środowisku biznesowym, gdzie liczy się czas i precyzja, takie narzędzia stają się nieocenioną pomocą. Młodzi profesjonaliści korzystają z nich również w obszarze marketingu i PR, tworząc treści do kampanii, analizując trendy w mediach społecznościowych czy przygotowując strategie komunikacyjne.

Co istotne, AI nie zastępuje kreatywności, lecz ją wspiera. Daje szybki dostęp do danych i inspiracji, które młodzi pracownicy mogą następnie przekształcić w unikalne projekty. W ten sposób sztuczna inteligencja staje się narzędziem zwiększającym efektywność i konkurencyjność młodych dorosłych na rynku pracy.

Rozrywka – kreatywność w erze algorytmów

AI nie ogranicza się do edukacji i pracy, a coraz częściej pojawia się także w sferze rozrywki i kultury. Młodzi dorośli korzystają z narzędzi generatywnych do tworzenia obrazów, muzyki czy treści w mediach społecznościowych. Popularne stało się generowanie memów, grafik czy krótkich filmów, które następnie trafiają na TikToka, Instagrama czy YouTube.

Dzięki AI każdy może stać się twórcą – wystarczy wpisać kilka słów, aby otrzymać obraz w wybranym stylu czy pomysł na post. To demokratyzuje kreatywność i pozwala młodym ludziom wyrażać siebie w nowych formach. Widać to szczególnie w kulturze internetowej, gdzie treści generowane przez AI stają się częścią codziennej komunikacji i budowania tożsamości online.

Rozrywka z AI to także gry, w których algorytmy tworzą dynamiczne światy i fabuły, dostosowując się do wyborów gracza. W ten sposób sztuczna inteligencja nie tylko wspiera naukę i pracę, ale także staje się integralnym elementem spędzania wolnego czasu.

Wnioski

Przykłady praktyczne pokazują, że AI przenika wszystkie sfery życia młodych dorosłych od edukacji, przez pracę, aż po rozrywkę. W każdym z tych obszarów pełni inną rolę: korepetytora, asystenta czy kreatywnego partnera. Wspólnym mianownikiem pozostaje jednak wygoda i szybkość, które budują zaufanie do technologii, ale jednocześnie wymagają krytycznego podejścia, aby nie zatracić własnej refleksji i odpowiedzialności.

Ryzyka i wyzwania

Jednym z największych zagrożeń związanych z korzystaniem z narzędzi sztucznej inteligencji jest możliwość generowania treści nieprawdziwych lub wprowadzających w błąd. Algorytmy nie posiadają własnej wiedzy – bazują na danych, które mogą być nieaktualne, niepełne albo obciążone błędami. W efekcie użytkownik otrzymuje tekst, który brzmi wiarygodnie, ale w rzeczywistości powiela fałszywe informacje. To szczególnie niebezpieczne w kontekście edukacji i pracy akademickiej, gdzie brak krytycznej weryfikacji może prowadzić do powielania mitów czy błędnych wniosków.

AI często podaje odpowiedzi w sposób pewny i uporządkowany, ale nie zawsze wskazuje źródła, na których się opiera. Brak transparentności utrudnia użytkownikom sprawdzenie, czy dana informacja pochodzi z wiarygodnego opracowania naukowego, czy z przypadkowego fragmentu internetu. To rodzi problem z weryfikacją – młodzi dorośli, przyzwyczajeni do szybkości i wygody, mogą nie podejmować dodatkowego wysiłku, by sprawdzić poprawność treści. W efekcie rośnie ryzyko bezrefleksyjnego zaufania do technologii, która nie zawsze jest w stanie odróżnić fakty od opinii.

Kolejnym wyzwaniem jest wpływ AI na rynek pracy. Młodzi profesjonaliści, choć chętnie korzystają z narzędzi sztucznej inteligencji, jednocześnie obawiają się, że automatyzacja może zagrozić ich zatrudnieniu. Badania pokazują, że część osób z pokolenia Z dostrzega ryzyko zastępowania pracy ludzkiej przez algorytmy – zwłaszcza w obszarach związanych z analizą danych, obsługą klienta czy tworzeniem treści. To rodzi ambiwalencję: z jednej strony AI jest postrzegane jako wsparcie i szansa na rozwój, z drugiej – jako potencjalne zagrożenie dla stabilności zawodowej.

Kto odpowiada za błędy AI?

Nie mniej istotnym wyzwaniem jest kwestia odpowiedzialności. Jeśli narzędzie AI wygeneruje błędną informację, kto ponosi za to konsekwencje – użytkownik, twórca algorytmu, czy firma udostępniająca technologię? Problem ten staje się szczególnie palący w kontekście edukacji i pracy zawodowej, gdzie błędy mogą mieć realne skutki: od niezaliczonej pracy po błędne decyzje biznesowe. Dyskusja o etyce AI wskazuje, że konieczne jest wypracowanie jasnych zasad odpowiedzialności i transparentności, aby użytkownicy wiedzieli, jakie ryzyko podejmują, korzystając z technologii.

Perspektywa przyszłościowa

Jak zmieni się poziom zaufania do AI?

Prognozy wskazują, że zaufanie młodych dorosłych do sztucznej inteligencji będzie rosło, ale w sposób zróżnicowany. Według raportu Deloitte „State of AI in the Enterprise” coraz więcej osób traktuje AI jako narzędzie codziennej pracy, jednak równocześnie rośnie świadomość jej ograniczeń i ryzyk. Oznacza to, że w kolejnych latach możemy spodziewać się bardziej krytycznego zaufania – młodzi będą korzystać z AI chętnie, ale z większą ostrożnością i potrzebą weryfikacji.

Obecnie większość młodych uczy się korzystania z AI samodzielnie – poprzez praktykę, media społecznościowe czy kursy online. Systemy edukacyjne muszą szybko dostosować programy nauczania, aby przygotować uczniów i studentów do pracy w świecie, gdzie AI jest wszechobecne. W Polsce pojawiają się pierwsze inicjatywy wprowadzania zajęć o sztucznej inteligencji na uczelniach, ale wciąż są to działania punktowe. W przyszłości kluczowe będzie włączenie edukacji o AI do podstawowych programów nauczania, tak aby młodzi nie tylko umieli korzystać z narzędzi, ale także rozumieli ich mechanizmy i ograniczenia.

Jakie kompetencje cyfrowe będą kluczowe?

Najważniejszą kompetencją przyszłości jest tzw. AI literacy – umiejętność krytycznego korzystania z narzędzi sztucznej inteligencji. Obejmuje ona:

– zdolność oceny wiarygodności informacji,

– rozumienie, jak działają algorytmy i jakie mają ograniczenia,

– świadomość ryzyka związanego z dezinformacją i etyką,

– umiejętność kreatywnego wykorzystania AI w pracy i nauce.

Według raportu World Economic Forum „Future of Jobs 2025”, kompetencje związane z krytycznym myśleniem, analizą danych i współpracą z technologią będą jednymi z najbardziej poszukiwanych na rynku pracy. To oznacza, że młodzi dorośli, którzy nauczą się mądrze korzystać z AI, zyskają przewagę konkurencyjną.

Podsumowanie

Wracając do pytania przewodniego – „Zaufaj, ale sprawdź?” – można powiedzieć, że relacja młodych dorosłych ze sztuczną inteligencją jest pełna ambiwalencji. Z jednej strony AI stało się narzędziem codzienności: wspiera w nauce, pracy i rozrywce, oferując szybkość, wygodę i dostęp do informacji w niespotykanej dotąd skali. Z drugiej strony młodzi użytkownicy coraz częściej dostrzegają, że bezrefleksyjne zaufanie do algorytmów niesie ze sobą ryzyko błędów, dezinformacji i utraty samodzielności poznawczej.

Ta podwójna postawa – entuzjazm i ostrożność – dobrze oddaje charakter pokolenia, które dorastało w świecie cyfrowym. Młodzi dorośli traktują AI jako naturalne narzędzie, ale równocześnie są świadomi, że technologia nie jest wolna od ograniczeń. Badania pokazują, że choć niemal wszyscy korzystają z AI, tylko niewielka część czuje się w pełni przygotowana do jej profesjonalnego wykorzystania. To dowód na to, że zaufanie do sztucznej inteligencji nie jest bezwarunkowe – wymaga krytycznej refleksji i umiejętności weryfikacji.

W tym miejscu kluczowe staje się krytyczne myślenie jako fundament cyfrowej dojrzałości. Nie wystarczy umieć obsługiwać narzędzia AI – trzeba także rozumieć, jak działają, jakie mają ograniczenia i jakie ryzyka generują. Krytyczne myślenie oznacza zadawanie pytań, kwestionowanie odpowiedzi, poszukiwanie źródeł i konfrontowanie informacji z innymi materiałami. To kompetencja, która chroni przed bezrefleksyjnym zaufaniem i pozwala młodym dorosłym korzystać z technologii w sposób świadomy i odpowiedzialny.

Co więcej, krytyczne podejście do AI nie jest tylko kwestią indywidualną – to także wyzwanie społeczne i edukacyjne. Systemy edukacji muszą nadążyć za potrzebami młodych, ucząc nie tylko obsługi narzędzi, ale przede wszystkim umiejętności oceny ich wiarygodności. W świecie, w którym algorytmy generują treści szybciej niż człowiek jest w stanie je zweryfikować, „zaufaj, ale sprawdź” staje się nie tyle radą, co koniecznością.

Bibliografia:

- Bakiera, L. (2013). Problem autorytetu z perspektywy psychologicznej. Czasopismo Psychologiczne, Uniwersytet im. Adama Mickiewicza.

- CEO.com.pl. . (2025). Generacja AI w Polsce: prawie wszyscy młodzi korzystają ze sztucznej inteligencji, ale niewielu jest gotowych na jej zawodowe wykorzystanie. Źródło: https://ceo.com.pl/generacja-ai-w-polsce-prawie-wszyscy-mlodzi-korzystaja-ze-sztucznej-inteligencji-ale-niewielu-jest-gotowych-na-jej-zawodowe-wykorzystanie-85467

- Deloitte. (2025). Deloitte Global’s 2025 Predictions Report: Generative AI: Paving the Way for a transformative future in Technology, Media, and Telecommunications. Źródło: https://www.deloitte.com/global/en/about/press-room/deloitte-globals-2025-predictions-report.html

- Ejdys, J. (2019). Zaufanie do technologii w e-administracji. Politechnika Białostocka.

- Filip Nocny. (2025). Heurystyka w copywritingu – jak wpływać na procesy decyzyjne. Źródło: https://filipnocny.pl/heurystyka-w-copywritingu-jak-wplywac-na-procesy-decyzyjne-w-tekstach-marketingowych

- Fundacja IT Girls. (2024). Pokolenie AI – raport o świadomości i korzystaniu z narzędzi sztucznej inteligencji przez młodych w Polsce. Źródło: https://itgirls.pl/pokolenie-ai-raport

- Kurcz, I. (2005). Psychologia języka i komunikacji. Wydawnictwo Naukowe Scholar.

- Microsoft & Talent Days. (2025). Generacja AI: młodzi Polacy na cyfrowym rynku pracy. Microsoft News. Źródło: https://news.microsoft.com/source/emea/2025/07/generacja-ai-97-mlodych-polakow-korzysta-ze-sztucznej-inteligencji-ale-tylko-12-czuje-sie-gotowych-do-pracy-z-jej-wykorzystaniem/?lang=pl

- OECD & Cisco. (2025). Artificial Intelligence and the Future of Work: Generational Perspectives. OECD Publishing. Źródło: https://www.oecd.org/ai/artificial-intelligence-future-work-generations.htm

- Penszko, P., Wasilewska, O. (2024). Krytyczne myślenie, ocena wiarygodności informacji. Wnioski z międzynarodowych badań edukacyjnych i przeglądu literatury. Instytut Badań Edukacyjnych.

- Tabletowo. (2025). Młodzi Polacy a AI – badanie Microsoft i Talent Days. Źródło: https://www.tabletowo.pl/mlodzi-polacy-a-ai-badanie-microsoft-talent-days/

- World Economic Forum. (2025). The Future of Jobs Report 2025. Źródło: https://www.weforum.org/publications/the-future-of-jobs-report-2025/digest